Para transacciones en tiempo real, necesitas un tipo de sistema: OLTP (Procesamiento de Transacciones en Línea). Para análisis, necesitas otro: OLAP (Procesamiento Analítico en Línea). OLTP es como Sonic the Hedgehog: siempre en movimiento, corriendo a toda velocidad, reaccionando al instante a los obstáculos y recogiendo anillos en el camino. OLTP procesa cada transacción rápida y predeciblemente. OLAP, en cambio, es más como Kirby: absorbe todo a su paso: montones de objetos, enemigos, mundos enteros. Los sistemas OLAP absorben volúmenes masivos de datos (millones y miles de millones de filas) para luego digerirlos y convertirlos en algo significativo, como un informe.

Y dado que los casos de uso son tan diferentes, es lógico que la arquitectura de servidores, los sistemas de almacenamiento e incluso los motores de bases de datos también sean distintos.

Aquí es donde llegamos al tema principal. En esta lectura extensa, hablaremos sobre OLAP, OLTP y el hardware que los respalda.

OLAP y OLTP: Qué Son y Por Qué Existen

Profundicemos un poco más en la tecnología detrás de cada uno.

OLAP y OLTP tienen objetivos y arquitecturas completamente diferentes. Por eso, para la mayoría de las empresas, la verdadera pregunta no es elegir entre uno u otro, sino determinar cómo combinarlos adecuadamente dentro de una única infraestructura.

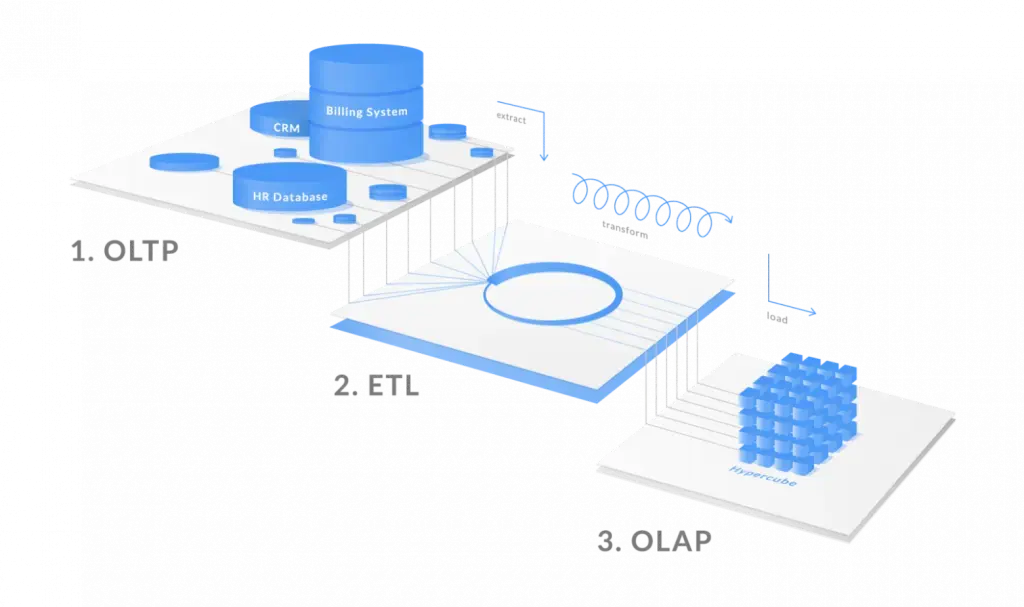

OLAP es una herramienta para el análisis complejo de grandes volúmenes de datos. Es cómo las empresas obtienen información analítica significativa. Tomemos como ejemplo el comercio minorista de alimentos: el equipo de análisis recopila todos los datos de ventas de un período determinado de múltiples fuentes, bases de datos operativas, servicios externos y otros sistemas. Todos estos datos se cargan luego en un sistema de almacenamiento especializado, un almacén de datos optimizado para análisis multidimensional.

A continuación, los analistas se preguntan:

“¿Cuánto mantequilla y pan se vendió en junio de 2024 en todas las tiendas de una región determinada, cómo cambiaron esos números en junio de 2025 y cuál es la relación entre estos productos?”

Responder a una pregunta así requiere agregar millones de filas, filtrar datos por regiones, categorías y fechas, y luego calcular correlaciones, cambios y pronósticos. Tales consultas pueden tomar tiempo —dentro de lo razonable— y eso es perfectamente normal, porque los resultados se utilizan para tomar decisiones comerciales y definir la estrategia a largo plazo.

En OLAP, la integridad y exactitud importan más que el tiempo de respuesta instantáneo. Por eso los análisis estratégicos —informes anuales o pronósticos a largo plazo— pueden ejecutarse durante una o dos horas. Es diferente cuando los análisis operativos para decisiones diarias, como cambios de precios, tardan horas en completarse; eso suele ser un signo de infraestructura inadecuada.

Nota al margen. Los analistas suelen trabajar a través de sistemas BI (Business Intelligence) no confundir con BIM, como Power BI, Tableau, Qlik, Looker o Apache Superset, donde las interfaces visuales les permiten crear consultas, paneles e informes sin un conocimiento profundo de SQL.

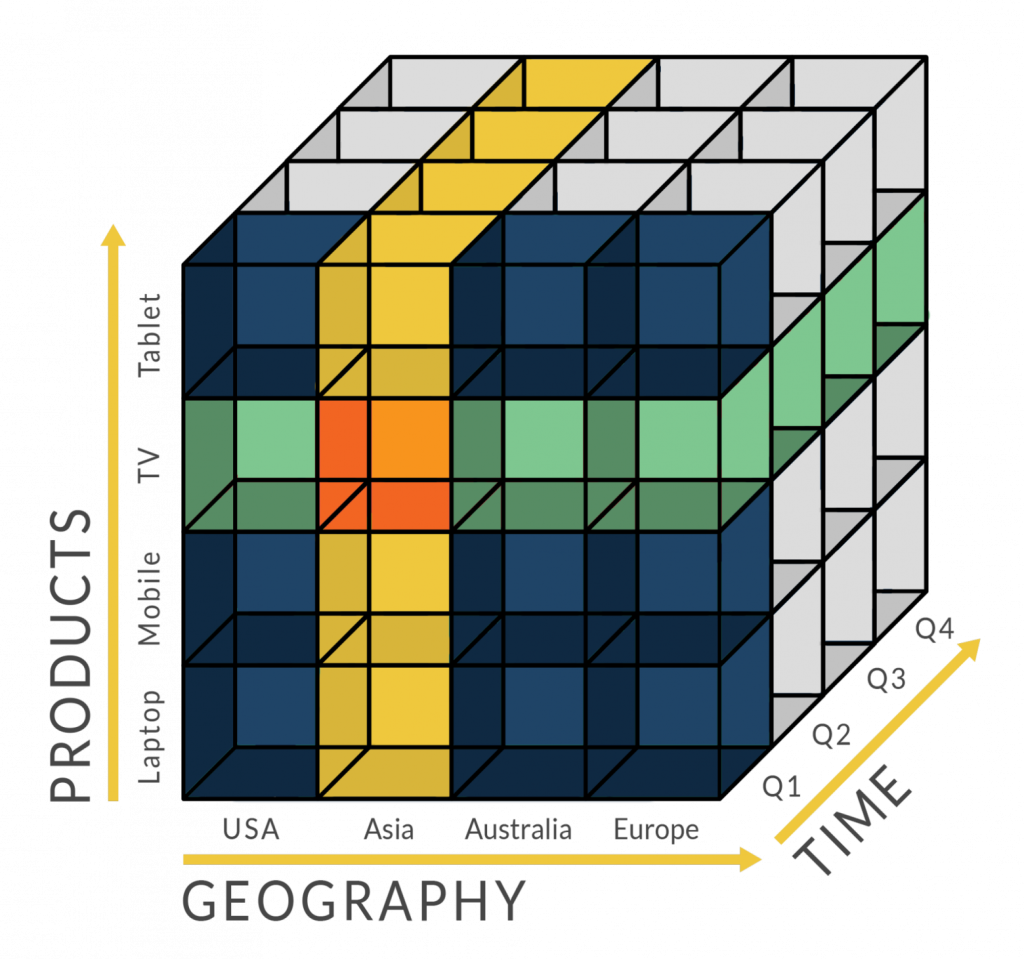

En el núcleo de OLAP están las estructuras de datos multidimensionales (cubos), que permiten ver los datos desde diferentes ángulos: tiempo, región, producto, cliente y docenas de otras dimensiones. Esto hace que OLAP sea una herramienta ideal para análisis estratégicos. A diferencia, por ejemplo, de los sistemas CRM, donde el objetivo principal es la gestión operativa de clientes y transacciones, no consultas complejas sobre terabytes de datos históricos de ventas.

Las herramientas OLAP clásicas incluyen ClickHouse, Greenplum, Hadoop/Spark y Amazon Redshift. Están diseñadas para procesamiento a gran escala y paralelismo.

OLTP, en cambio, está diseñado para la velocidad al procesar operaciones individuales. En una caja de supermercado, cada transacción: escaneo de un artículo, recepción de pago, escritura del registro, debe ocurrir al instante. Cualquier retraso significa que las colas crecen y los clientes se van. Nadie va a esperar tres minutos por artículo solo para comprar mantequilla y pan.

Los sistemas OLTP están optimizados específicamente para estas operaciones rápidas, frecuentes y en tiempo real. Pero usarlos para análisis estratégicos es casi inútil; las consultas complejas sobre conjuntos masivos de datos simplemente no son para lo que fueron diseñados.

Las bases OLTP típicas incluyen PostgreSQL, MySQL/InnoDB, Oracle Database y Microsoft SQL Server.

También existen soluciones híbridas llamadas HTAP (Procesamiento Transaccional/Analítico Híbrido) que intentan combinar transacciones y análisis dentro de un único sistema, como TiDB, SAP HANA o YugabyteDB. En la práctica, sin embargo, la mayoría de las empresas aún separan las cargas: una base maneja operaciones rápidas, otra maneja análisis. La conveniencia de los sistemas híbridos viene a costa de mayor complejidad de infraestructura y mayores requisitos de hardware.

Aquí es donde los arquitectos de TI, administradores o cualquier persona responsable comienzan a hacerse preguntas. ¿Qué servidor debe usarse para OLAP y cuál para OLTP? ¿Deben ser servidores separados? ¿Máquinas virtuales? ¿Un clúster? ¿Tal vez nodos de cómputo combinados con almacenamiento separado? ¿Cuántos sistemas de almacenamiento se necesitan? Si hay varios, ¿deben ser activo-activo o activo-pasivo? Y esto es solo el comienzo; hay docenas, si no cientos, de detalles similares.

Y esos detalles afectan directamente al negocio.

No podré responder todas las posibles preguntas; cada carga de trabajo es diferente, pero intentaré darte puntos de referencia útiles. Y, como siempre, los comentarios son bienvenidos.

Cómo Elegir Servidores y Almacenamiento para OLTP y OLAP

Seleccionar servidores para OLTP y OLAP son dos tareas muy diferentes, y los errores aquí son costosos. Pon almacenamiento lento bajo OLTP y obtendrás colas de solicitudes y clientes descontentos. Intenta ejecutar OLAP en servidores inadecuados y verás consultas ejecutándose durante semanas. Ahorrar en redundancia de datos y componentes… bueno, ya sabes cómo termina eso.

En sistemas de bases de datos de alta carga, el rendimiento y la fiabilidad dependen directamente de la arquitectura y el hardware. Pero antes de comprar equipos, primero vienen las decisiones arquitectónicas. Comencemos con OLTP.

Arquitectura OLTP: Velocidad y Previsibilidad

Los sistemas OLTP son la primera línea del negocio. Banca en línea, pasarelas de pago y plataformas de comercio electrónico funcionan sobre ellos. Estos sistemas tienen requisitos claros: decenas o cientos de miles de transacciones por segundo, SLA de latencia estrictos medidos en milisegundos e integridad de datos; perder un solo registro de transacción equivale a perder dinero.

Cada sistema transaccional se construye alrededor de los requisitos ACID (Atomicidad, Consistencia, Aislamiento, Durabilidad). En términos simples:

-

Una transacción se ejecuta completamente o no se ejecuta (Atomicidad)

-

Los datos permanecen en un estado consistente (Consistencia)

-

Las operaciones en paralelo no interfieren entre sí (Aislamiento)

-

Los datos no se pierden incluso en caso de fallo (Durabilidad)

Al observar dicho sistema, un arquitecto de TI no comienza pensando en hardware. Las preocupaciones principales son cómo normalizar los datos para que las transacciones sean rápidas y consistentes; cómo distribuir la carga a través de clústeres usando sharding y replicación; y cómo diseñar tolerancia a fallos para que el fallo de uno —o varios— nodos no derribe todo el sistema.

Conclusión:

Si la simplicidad importa y la carga esperada es moderada, la elección óptima es una combinación de replicación y caché como por ejemplo, PostgreSQL o MySQL con Redis. Cuando el volumen de datos crece y la carga aumenta linealmente, y la consistencia global estricta no es crítica, las arquitecturas shared-nothing con sharding tienen más sentido. Si la consistencia estricta es la máxima prioridad —y el presupuesto lo permite— las soluciones shared-disk como Oracle RAC son la mejor opción. Para sistemas que requieren velocidad extrema de procesamiento o análisis en tiempo real, vale la pena considerar bases de datos en memoria.

En la tabla a continuación, he resumido los principales enfoques arquitectónicos utilizados al diseñar sistemas OLTP.

|

Tecnología / Enfoque |

Cómo Funciona |

Ventajas |

Desventajas |

Cuándo Usar |

|

Shared-Disk |

Todos los nodos acceden al almacenamiento compartido (SAN/NAS). Coordinación gestionada por el motor de BD (p. ej., Oracle RAC). |

Base de datos lógica única, sin sharding manual, balanceo automático de carga |

Muy caro, hardware especializado, cuellos de botella en almacenamiento |

Banca, facturación telecom, consistencia estricta |

|

Shared-Nothing / Sharding |

Cada nodo posee su porción de datos. Nodos se comunican por red (p. ej., Cassandra, CockroachDB). |

Escalado casi lineal, sin cuellos de botella únicos de almacenamiento |

Lógica de sharding compleja, joins difíciles |

Redes sociales, marketplaces, gaming |

|

Replicación / Clustering |

Datos replicados en nodos para HA y escalado de lectura |

Alta disponibilidad, failover |

Escrituras no escalan, retardo en replicación |

Cargas con predominio de lectura |

|

Caché |

Datos calientes en memoria (Redis, Memcached) |

Descarga 70–80% de la carga DB, extremadamente rápido |

Complejidad en invalidación de caché |

APIs, e-commerce, motores de recomendación |

|

Bases In-Memory |

Datos almacenados principalmente en RAM |

Velocidad máxima, análisis en tiempo real |

Caro, alto consumo de RAM |

HFT, telecom, IoT |

|

Arquitectura de Microservicios |

Lógica de negocio dividida en servicios independientes (a menudo Kubernetes) |

Escalabilidad, autonomía de equipos |

Sobrecarga operacional |

Sistemas grandes y dinámicos |

|

Message Brokers |

Comunicación asincrónica (Kafka, RabbitMQ) |

Desacoplamiento, resiliencia |

Complejidad de depuración, latencia |

Picos de carga, integraciones complejas |

La conclusión es simple. Si optimizas OLTP como si fuera OLAP, matarás la latencia. Si ejecutas OLAP en infraestructura de nivel OLTP, tus analistas estarán viendo barras de progreso en lugar de paneles. Los errores de arquitectura aquí no aparecen en benchmarks, se reflejan en ingresos perdidos, SLA incumplidos y reuniones muy incómodas.