Saludos a nuestros lectores habituales… y a todos los que acaban de llegar por aquí.

¿Qué has oído recientemente sobre las últimas tendencias en refrigeración de servidores? ¿Refrigeración líquida, quizá? ¿Centros de datos en el fondo del océano?

Todo eso es fascinante, sin duda. Pero si el titular sobre servidores sumergidos en agua hirviendo te llamó la atención; si nunca has oído hablar del uso de agua potable para refrigeración, no tienes idea de qué es la refrigeración capilar de CPUs, y el término PUE no te dice absolutamente nada, entonces has llegado al lugar correcto.

En este artículo te guiaré por cómo la industria de la refrigeración de servidores se está adaptando a chips cuyo TDP avanza a toda velocidad hacia la marca de los 1000 vatios.

Advertencia: lectura larga.

Prepárate un termo con té, café o algo más fuerte… para que no te enfríes 🙂

Todo el mundo quiere un PUE más bajo

El PUE (Power Usage Effectiveness) es la métrica más utilizada en la industria de los centros de datos para medir la eficiencia energética de la infraestructura. Es excelente para seguir la evolución de un centro de datos concreto a lo largo del tiempo y para evaluar el impacto de distintas decisiones: cambiar sistemas de refrigeración, reorganizar el equipamiento, etc.

Funciona mejor cuando se aplica a una instalación específica, ayudando a entender qué soluciones realmente mejoran la eficiencia energética en la práctica.

La métrica fue introducida en 2007 por The Green Grid (TGG), un consorcio industrial sin ánimo de lucro centrado en mejorar la eficiencia de recursos en centros de datos. Entre sus miembros —actuales o pasados— están prácticamente todos los peces gordos del hardware de servidores, componentes, software y servicios cloud: AMD, Nvidia, Dell, HPE, IBM, Intel, Microsoft, Google, Cisco, Oracle, AWS y muchos más.

La fórmula del PUE es sencilla:

PUE = Consumo total de la instalación / Consumo del equipamiento IT

El equipamiento IT incluye todo lo que realiza cómputo real: servidores, sistemas de almacenamiento, equipos de red, además de dispositivos auxiliares como switches KVM, monitores y estaciones de trabajo o portátiles usados para monitorizar o gestionar el centro de datos.

El consumo total de la instalación incluye todo lo que el sitio consume: el equipamiento IT más los sistemas de suministro eléctrico, UPS, cuadros de conmutación, generadores, PDUs, baterías y todas las pérdidas energéticas fuera del propio hardware IT. A eso se suman los sistemas de refrigeración: chillers, torres de refrigeración, bombas, unidades CRAC (Computer Room Air Conditioning), sistemas DX (Direct Expansion) y —mis siglas favoritas— las unidades CRAH (Computer Room Air Handling). Además, hay cargas secundarias como iluminación, control de accesos y otra infraestructura del edificio.

En teoría, el PUE perfecto es 1,0. Eso significaría que el 100 % de la energía se destina al cómputo y cero a la infraestructura: refrigeración, iluminación y todo lo demás. En la práctica, es inalcanzable. Pero cuanto más bajo sea el PUE, mejor.

Es un poco como intentar alcanzar la velocidad de la luz en los viajes espaciales: puedes acercarte cada vez más, pero ningún objeto con masa distinta de cero llegará realmente allí.

Si tomamos un PUE casi de ciencia ficción de 1,03, eso significa que por cada 100 vatios usados en cómputo, el centro de datos necesita solo 3 vatios para todo lo demás.

¿Y el mayor obstáculo para reducir el PUE? La refrigeración.

Solo la refrigeración puede representar hasta el 40–50 % del consumo energético total de una instalación. Con sistemas clásicos basados en aire, normalmente estás más cerca del extremo superior —alrededor del 50 %—. La refrigeración líquida o el free cooling pueden reducirlo al 20–30 %, o incluso menos en condiciones favorables.

Así que hablemos de las soluciones concretas que se utilizan para reducir el PUE desde el punto de vista de la refrigeración.

Spoiler: hay muchas. Y todas dependen de la edad y el tamaño de la instalación, el equipamiento utilizado, la ubicación geográfica, los niveles de utilización y muchos otros factores.

Enfriar el hardware

Empecemos por lo básico.

Todo lo que funciona con electricidad genera calor. En los electrodomésticos, ese calor suele ser pequeño y rara vez requiere medidas especiales: los ingenieros suelen confiar en la refrigeración pasiva, es decir, la disipación natural del calor mediante el flujo de aire, o más formalmente, la convección.

En casos raros (excluyendo PCs, smartphones y portátiles), algunos dispositivos domésticos pueden tener un pequeño ventilador, como el de mi pistola de masaje percutor.

Las grandes excepciones en casa son los aires acondicionados y los frigoríficos. La refrigeración pasiva o un par de ventiladores no son suficientes. Estos dispositivos no solo disipan calor: lo extraen activamente de un espacio cerrado para mantener una temperatura baja constante.

Ahí entran los refrigerantes: sustancias especiales que circulan en un circuito cerrado, absorben calor dentro del frigorífico o del aire acondicionado y lo liberan al exterior. Por eso los frigoríficos a veces zumban (el compresor está comprimiendo el refrigerante) y se sienten calientes por fuera (las bobinas del condensador expulsan el calor). Todo esto forma parte de lo que se conoce como el ciclo termodinámico de refrigeración.

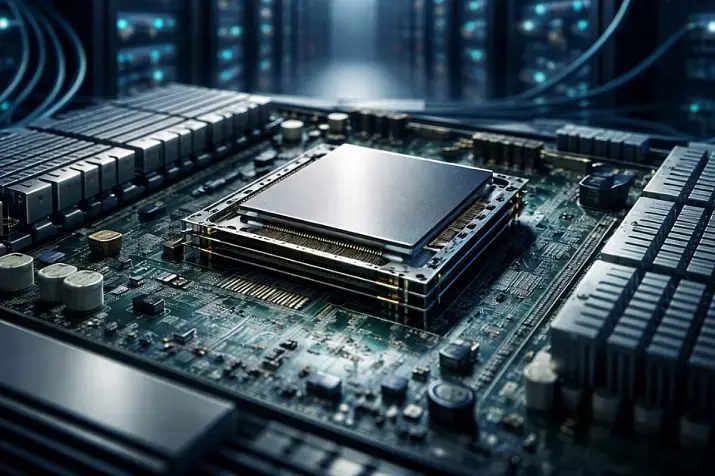

Volvamos ahora a nuestro tema favorito: los servidores.

Utilizan una combinación de refrigeración pasiva (disipadores), ventiladores y sistemas similares a los de un frigorífico: chillers o sistemas de refrigeración líquida con cambio de fase. La refrigeración puede dirigirse al propio servidor (sus componentes internos) o al entorno que lo rodea, normalmente gestionado por sistemas de aire acondicionado.

Cubriré todos estas estrategias —incluidas algunos bastante poco convencionales—. Iremos de lo simple a lo extremo (sí, el agua hirviendo llega al final).

Refrigeración pasiva y por aire: PUE 1,5–2,0

Bajo coste inicial, pero limitada e ineficiente

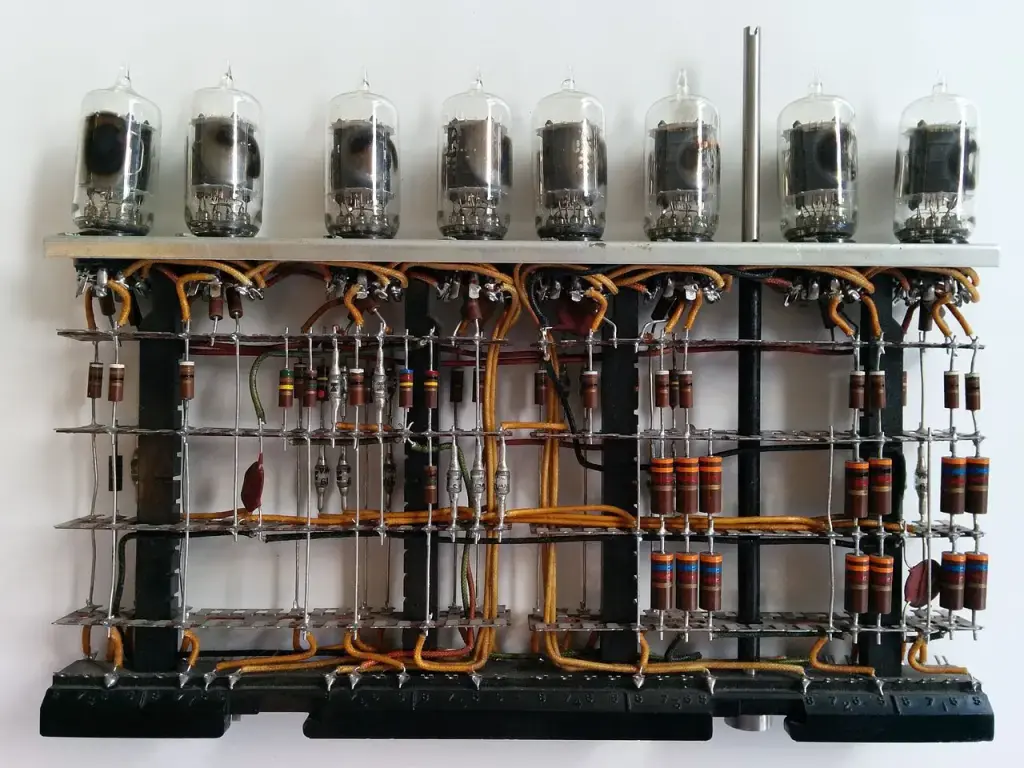

En la era de los primeros ordenadores electrónicos —ENIAC, IBM 701 y máquinas similares de las décadas de 1940 y 1950— no existía refrigeración activa. La convección natural y una ventilación básica de la sala eran suficientes.

Sí, esas máquinas generaban decenas de kilovatios de calor. Pero la densidad de componentes era baja —todo se construía con válvulas de vacío—, por lo que el problema se resolvía mediante el diseño del espacio y la arquitectura.

En los años 60 llegaron los transistores, reduciendo drásticamente el tamaño de los ordenadores y sus componentes. Comenzó así la era de los primeros sistemas con refrigeración activa. Los mainframes como el IBM System/360 ya dependían de ventiladores, que pronto se convirtieron en el estándar.

En los años 80, los ordenadores personales comenzaron su conquista global. Sistemas como el IBM PC usaban ventiladores en sus fuentes de alimentación.

El Apple II, en cambio, se basaba exclusivamente en refrigeración pasiva. Steve Jobs rechazaba los ventiladores porque, según sus palabras, “un ventilador dentro de un ordenador viola los principios Zen y distrae del trabajo”. Adoptó un enfoque similar con el Apple III, con los previsibles problemas de sobrecalentamiento.

Con el tiempo, las CPUs se volvieron más calientes. A finales de la década, algunos modelos ya requerían disipadores. El legendario Intel 80486 —especialmente el 486 DX2-66 de mayor frecuencia— fue uno de los primeros procesadores que realmente necesitó un sistema de refrigeración (disipador con ventilador).

Y a partir de ahí, la tecnología de refrigeración evolucionó de forma constante…

En mi opinión, la refrigeración por aire alcanzó su punto máximo a principios de los años 2000. Fue cuando aparecieron diseños cada vez más sofisticados: heat pipes, disipadores de cobre, ventiladores de altas RPM y la ahora estándar disposición de pasillo frío / pasillo caliente en salas de servidores y centros de datos (los servidores aspiran aire frío por delante y expulsan aire caliente por detrás).

La refrigeración por aire también empezó a combinarse con soluciones líquidas: sistemas AIO (All-in-One) y circuitos personalizados, especialmente en equipos de alto rendimiento y configuraciones con overclocking.

Dato curioso: en los servidores, las CPUs normalmente no tienen disipadores individuales. En su lugar, el flujo de aire se canaliza cuidadosamente a través de conductos y se impulsa directamente a través de los disipadores montados sobre los procesadores.

Desde entonces, la refrigeración por aire ha seguido siendo el enfoque más común tanto en PCs como en servidores. Su popularidad se debe al bajo coste, la fiabilidad relativa y la simplicidad. Pero está lejos de ser perfecta. La eficiencia disminuye a medida que aumenta la densidad de componentes o racks. El ruido de los ventiladores puede ser brutal (por eso los servidores deben estar en salas de servidores: trabajar al lado de uno no es precisamente agradable). La acumulación de polvo implica limpieza regular o filtrado de aire, lo que en centros de datos se traduce en potentes sistemas HVAC.

Dicho esto, incluso este inconveniente puede convertirse en una ventaja: el calor residual puede recuperarse y reutilizarse, por ejemplo, para calentar oficinas o incluso edificios residenciales cercanos.

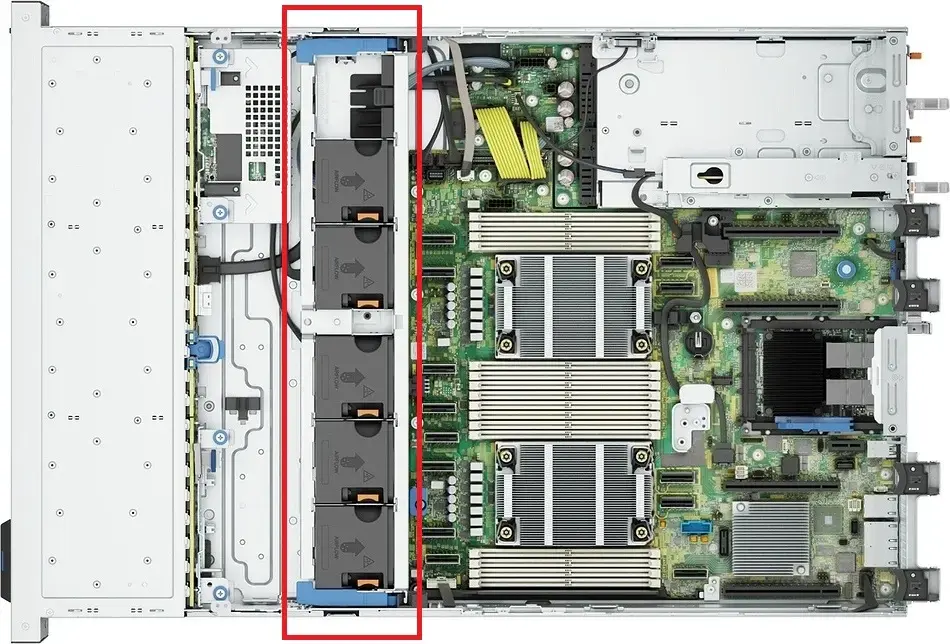

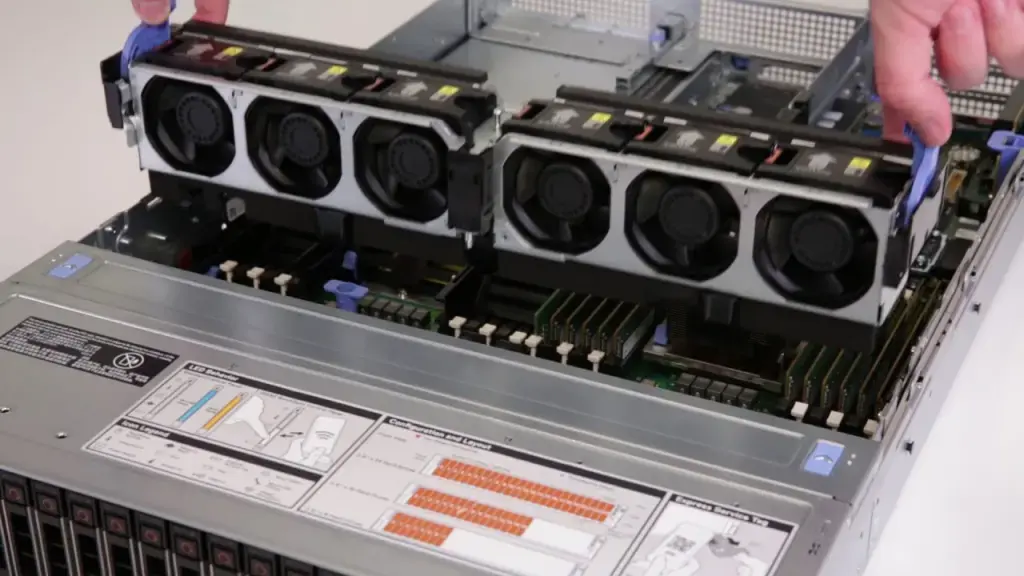

Refrigeración por aire en servidores ≠ refrigeración por aire en PCs

La refrigeración por aire en servidores es bastante diferente de la que vemos en PCs de escritorio. La mayoría de los servidores son sistemas planos de 1U o 2U (donde 1U equivale a 44,45 mm de altura), lo que deja sin espacio para ventiladores estándar de 120 mm. Con el espacio al límite, el aire se fuerza a través de canales estrechos, creando altas velocidades de flujo y mucha turbulencia.

Los administradores de sistemas veteranos quizá recuerden módulos de refrigeración como este:

Un gran ventilador centrífugo (blower) de 120 mm en el centro, flanqueado por dos ventiladores más pequeños a los lados.

Hoy en día, sin embargo, la mayoría de los servidores utilizan ventiladores compactos de altas RPM, normalmente de 40×40 mm o 60×60 mm. En sistemas más grandes (4U o más), ocasionalmente se ven ventiladores mayores. Las velocidades típicas oscilan entre 10 000 y 20 000 RPM, a veces incluso más.

De ahí proviene el famoso ruido de los servidores. Podría describirse como “similar al de un motor a reacción”: cuanto más pequeñas son las aspas, más fuerte y agudo es el sonido (junto con la frecuencia de vibración).

Sistemas de refrigeración líquida (LCS)

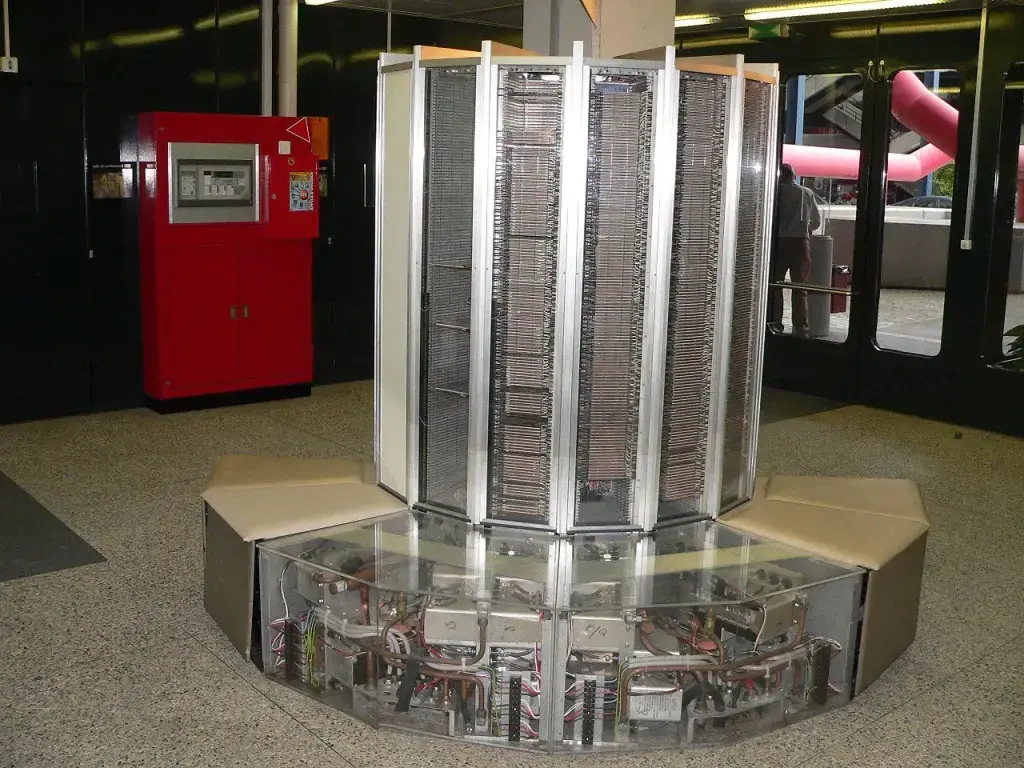

Los primeros experimentos con refrigeración líquida para electrónica se remontan a los años 80. La disipación térmica de los procesadores aumentaba rápidamente y los ingenieros buscaban alternativas. En los 90, el concepto empezó a ser comercialmente viable. Por ejemplo, los superordenadores Cray utilizaban refrigeración líquida con tuberías basadas en Freón para extraer el calor.

El mecanismo era similar al de un frigorífico doméstico y se basaba en el efecto Joule–Thomson: la temperatura del refrigerante disminuye a medida que baja la presión al pasar por una sección estrecha del tubo.

En sentido estricto, este sistema se describe mejor como refrigeración líquida bifásica (o simplemente un chiller), ya que el refrigerante cambia de fase. Como puedes imaginar, era una solución voluminosa, compleja y cara, muy lejos del alcance de los usuarios comunes.

Los años 2000: la refrigeración líquida se populariza

El verdadero auge llegó en los años 2000, cuando overclockers, gamers y entusiastas del hardware empezaron a construir circuitos personalizados con bombas, tubos, bloques de agua y radiadores.

En aquella época, no todo el mundo podía instalar refrigeración líquida en una CPU o GPU. Para ser precisos: no todo el mundo podía, y muy pocos realmente deberían haberlo intentado. Era casi una forma de arte y, para algunos, un hobby o incluso una profesión.

El proceso era complejo, caro y no estaba exento de riesgos. Una fuga podía destruir un sistema en segundos, provocar un cortocircuito o, en el peor de los casos, iniciar un incendio.

Por eso los sistemas AIO (All-in-One) despegaron en la década de 2010. Circuitos preensamblados y sellados como el Corsair H100 o el NZXT Kraken hicieron que la refrigeración líquida fuera accesible para las masas. De repente, cualquiera que supiera montar un PC podía instalar un sistema de refrigeración líquida en casa.

Y sí, también hubo algunos experimentos de consumo realmente salvajes con refrigerantes.

Dato interesante: algunos sistemas utilizan líquidos dieléctricos especiales que no conducen electricidad, reduciendo el riesgo de daños en caso de fuga.

Refrigeración líquida para servidores: New Game+, PUE 1,15–1,35

La refrigeración líquida directa (DLC) —también conocida como Direct-to-Chip (D2C)— es un método para extraer calor de los componentes del servidor (CPUs, GPUs y otros) mediante contacto directo con un líquido refrigerante.

Los sistemas DLC pueden ser monofásicos o bifásicos, pero el principio es el mismo: el líquido extrae el calor directamente de los componentes más calientes. El sistema funciona en un circuito cerrado, donde el refrigerante “baña” CPUs y GPUs a través de placas frías metálicas montadas directamente sobre los puntos más calientes. Estas placas actúan como esponjas térmicas, absorbiendo energía.

El líquido caliente se dirige entonces a una CDU (Coolant Distribution Unit) —el corazón del sistema—, que transfiere el calor al circuito principal de refrigeración de la instalación. Lo que sucede posteriormente depende de la creatividad de los ingenieros: recuperación de calor (hasta calefacción urbana para edificios cercanos), conexión a un circuito de agua fría, torres de refrigeración evaporativa (con estética de central nuclear) o simples dry coolers.

Una vez enfriado, el líquido regresa a los chips: una especie de ciclo del agua de la naturaleza… pero dentro de una sala de servidores.

La refrigeración líquida directa tiene una demanda enorme en servidores de alta densidad equipados con CPUs de gama alta y aceleradores de IA que generan cantidades masivas de calor. Por ejemplo, el Nvidia H100 tiene un TDP de 700 W, mientras que el próximo Nvidia B200 alcanza unos impresionantes 1000 W. Los procesadores Intel Xeon y AMD EPYC modernos disipan habitualmente entre 300 y 400 W cada uno.

Y recuerda: en grandes centros de datos hay miles —a veces decenas de miles— de estos chips, con múltiples procesadores por servidor. A esa escala, el aire simplemente no puede eliminar el calor con la suficiente rapidez, especialmente en racks densos donde cada centímetro cuenta.

Una nota rápida

El TDP (Thermal Design Power) es una métrica que describe la cantidad máxima de calor que se espera que genere un procesador, GPU u otro chip cuando funciona a su frecuencia base, sin turbo ni overclocking del usuario. Se utiliza principalmente para dimensionar una solución de refrigeración: cuanto mayor sea el TDP, más potente deberá ser el disipador y/o el radiador.

Algunos matices importantes:

El TDP no es lo mismo que el consumo real. Las CPUs pueden —y a menudo lo hacen— superar su TDP nominal durante periodos cortos al activar el turbo. Además, los fabricantes calculan el TDP de forma diferente: Intel y AMD utilizan metodologías distintas, por lo que las comparaciones directas no siempre son precisas.

El TDP es especialmente crítico en dispositivos compactos como smartphones y portátiles, donde el calor de los componentes vecinos puede provocar rápidamente sobrecalentamiento y throttling. Las cajas ATX espaciosas, en cambio, son mucho más tolerantes a pequeñas desviaciones.

Por qué importa la DLC

La refrigeración líquida directa permite a los centros de datos alojar más equipamiento en el mismo espacio, reduciendo al mismo tiempo el consumo energético entre un 30 y un 50 %. Estos sistemas son más silenciosos —ideales para oficinas y salas de servidores in situ— y dependen mucho menos de la temperatura ambiente, lo que los hace especialmente atractivos en climas cálidos. Además, acumulan menos polvo, lo que reduce los requisitos de calidad del aire en la sala.

Por supuesto, también hay desventajas. La instalación y el despliegue son costosos (aunque a menudo se compensan con el tiempo gracias al ahorro energético, especialmente si se tienen en cuenta los precios locales de la electricidad). La DLC requiere infraestructura adicional: radiadores, bombas, intercambiadores de calor. No todos los edificios son adecuados. Y aunque los sistemas modernos son muy seguros, el riesgo de fugas nunca es exactamente cero.

Si ampliamos la perspectiva: la DLC es el futuro de la refrigeración de servidores en centros de datos. A medida que aumenta la densidad del hardware y las cargas de trabajo de IA se convierten en la norma, la demanda de esta tecnología solo crecerá. Sigue siendo cara, pero ya es ampliamente utilizada por los grandes del sector —Google, Microsoft, Amazon, Meta, Tencent— y poco a poco se abre camino en empresas pequeñas y medianas, especialmente en regiones con electricidad cara, donde el retorno de la inversión es imposible de ignorar.

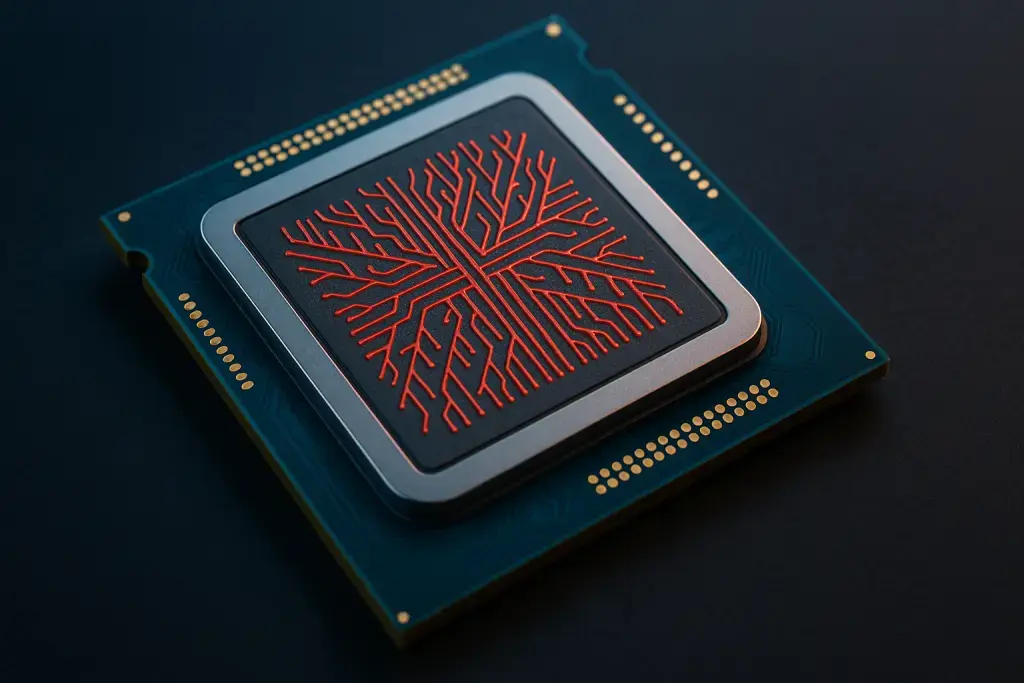

Lo que se está desarrollando ahora: refrigeración capilar dentro de la CPU

¿Y si la refrigeración viviera dentro del propio procesador?

La industria está experimentando con microcanales grabados directamente en el silicio, permitiendo que el refrigerante fluya justo al lado del die. Menos capas entre la fuente de calor y el refrigerante significa menor resistencia térmica… y una evacuación del calor mucho más rápida.

Suena perfecto. Pero, como siempre, hay una trampa: las fluctuaciones de presión dentro del sistema pueden crear puntos calientes y bruscos cambios de temperatura.

Investigadores de Microsoft decidieron tomar prestado un truco de la biología. Diseñaron microcanales que imitan un sistema circulatorio: arterias, venas y capilares. Las zonas más calientes del chip reciben más refrigerante; las más frías, menos. Los resultados son impresionantes: las temperaturas máximas se redujeron en 18 °C, la presión del sistema cayó un 67 % y la variación térmica entre núcleos se redujo a un tercio.

¿Lo mejor? Este enfoque es compatible con la tecnología CMOS (Complementary Metal-Oxide-Semiconductor), la base de la fabricación moderna de chips. Estos microcanales pueden grabarse directamente en el silicio durante la fabricación e integrarse en procesadores actuales. En el futuro, la refrigeración podría dejar de ser un sistema externo y convertirse en parte del propio chip.

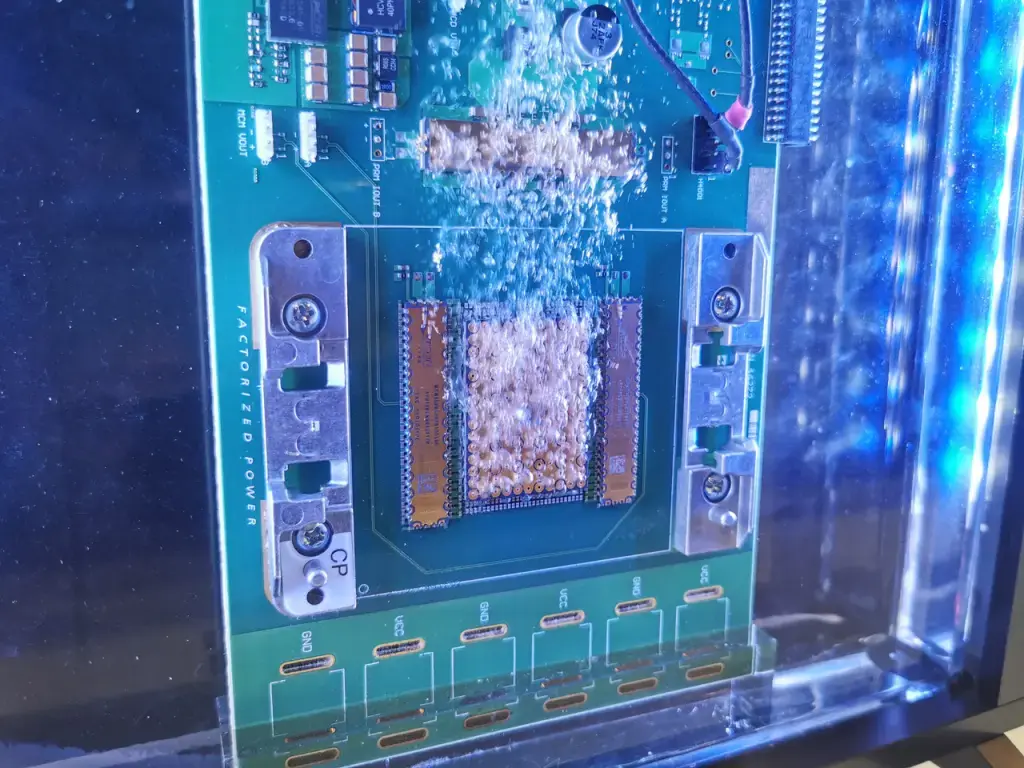

¿Todavía no hemos hervido nada? La refrigeración por inmersión viene a por ti PUE ≈ 1,03–1,10

La refrigeración por inmersión es exactamente lo que suena: el servidor se sumerge completamente en un líquido para un intercambio térmico directo (aunque también existen conceptos de inmersión parcial). ¿Para qué bombear refrigerante a través de un laberinto de tubos hacia componentes individuales, cuando puedes sumergir todo el sistema en un fluido térmicamente conductor?

Visualmente, se parece un poco a una freidora industrial… pero para servidores. El tanque incluso puede contener aceite, aunque el mismo con el que cocinarías. Aquí no hay patatas fritas.

El agua común no sirve (aunque el agua destilada técnicamente no conduce electricidad). En su lugar, los sistemas de inmersión utilizan fluidos sintéticos especialmente diseñados, aceites minerales o fluorocarbonos. Estos líquidos no son conductores (seguros para la electrónica), tienen una alta capacidad térmica y son excelentes extrayendo calor de los componentes.

Y aquí es donde, por fin, llegamos a la refrigeración de servidores con líquido hirviendo.

Pero eso…

lo veremos la semana que viene.