Witajcie nasi stali czytelnicy - i wszyscy, którzy właśnie do nas trafili!

Co słyszeliście o najnowszych trendach w chłodzeniu serwerów? Chłodzenie cieczą? A może centra danych umieszczane na dnie oceanu?

To wszystko brzmi fascynująco, oczywiście. Jeśli jednak nagłówek o serwerach zanurzonych we wrzącej wodzie przykuł waszą uwagę; jeśli nigdy nie słyszeliście o wykorzystaniu wody pitnej do chłodzenia, nie macie pojęcia, czym jest kapilarne chłodzenie CPU, a skrót PUE nie mówi wam absolutnie nic - to trafiliście we właściwe miejsce.

W tym artykule przeprowadzę was przez to, jak branża chłodzenia serwerów dostosowuje się do układów, których TDP zbliża się do granicy 1000 watów.

Uwaga: przed nami obszerna lektura.

Weźcie termos z herbatą, kawą albo czymś mocniejszym - aby uniknąć wychłodzenia 🙂

Wszyscy dążą do niższego PUE

PUE (Power Usage Effectiveness) to najczęściej stosowany w branży centrów danych wskaźnik służący do pomiaru efektywności energetycznej infrastruktury. Świetnie nadaje się do śledzenia ewolucji konkretnego obiektu w czasie oraz do oceny wpływu podejmowanych decyzji - takich jak zmiana systemu chłodzenia czy rekonfiguracja sprzętu.

Wskaźnik ten wykazuje największą wartość diagnostyczną, gdy odnosi się do konkretnego obiektu - pomaga wówczas zrozumieć, które rozwiązania realnie poprawiają efektywność energetyczną w warunkach operacyjnych.

Wskaźnik ten został wprowadzony w 2007 roku przez The Green Grid (TGG) - organizację non-profit skupiającą się na poprawie efektywności wykorzystania zasobów w centrach danych. Wśród jej członków znajdowali się lub znajdują praktycznie wszyscy kluczowi gracze rynku sprzętowego, komponentowego, oprogramowania oraz usług chmurowych: AMD, Nvidia, Dell, HPE, IBM, Intel, Microsoft, Google, Cisco, Oracle, AWS i wielu innych.

Wzór na PUE jest prosty:

PUE = całkowity pobór mocy obiektu / pobór mocy sprzętu IT

Kategoria sprzętu IT obejmuje wszystkie jednostki wykonujące operacje obliczeniowe: serwery, systemy pamięci masowej, urządzenia sieciowe, a także osprzęt pomocniczy, taki jak przełączniki KVM, monitory oraz stacje robocze wykorzystywane do monitorowania i zarządzania infrastrukturą.

Całkowity pobór mocy obiektu obejmuje natomiast całkowite zużycie energii w danej lokalizacji: sprzęt IT wraz z elementami dystrybucji zasilania, systemami UPS, rozdzielniami, generatorami, jednostkami PDU, bateriami oraz wszelkimi stratami energii poza samym sprzętem IT. Do tego dochodzą systemy chłodzenia - chillery, wieże chłodnicze, pompy, jednostki CRAC (Computer Room Air Conditioning), systemy DX (Direct Expansion) - oraz mój osobisty faworyt w kategorii „niefortunnych skrótów”: jednostki CRAH (Computer Room Air Handling). Na koniec należy doliczyć obciążenia wtórne: oświetlenie, systemy kontroli dostępu oraz pozostałą infrastrukturę budynkową.

Teoretycznie idealna wartość PUE wynosi 1,0.

Oznaczałoby to, że 100% energii trafia bezpośrednio na obliczenia, a 0% na infrastrukturę - chłodzenie, oświetlenie i całą resztę. W praktyce jest to nieosiągalne. Ale im niższa wartość wskaźnika PUE, tym lepiej.

To trochę jak próba osiągnięcia prędkości światła w podróżach kosmicznych: można się coraz bardziej zbliżać, ale żaden obiekt o niezerowej masie nigdy jej nie osiągnie.

Przyjmując niemal futurystyczny wskaźnik PUE na poziomie 1,03, oznacza to, że na każde 100 watów zużywanych na obliczenia, centrum danych potrzebuje zaledwie 3 watów na obsługę całej reszty.

A co stanowi największą przeszkodę w obniżaniu PUE?

Chłodzenie.

Przy klasycznych systemach opartych na powietrzu zazwyczaj oscylujemy wokół górnej granicy - ok. 50%. Chłodzenie cieczą lub technologia free cooling może obniżyć ten udział do 20–30%, a w sprzyjających warunkach nawet poniżej tych wartości.

Porozmawiajmy więc o konkretnych rozwiązaniach, które pozwalają obniżyć PUE z perspektywy chłodzenia.

Spoiler: jest ich sporo - i wszystkie zależą od wieku oraz wielkości obiektu, używanego sprzętu, lokalizacji geograficznej, poziomu wykorzystania i wielu innych czynników.

Chłodzenie sprzętu w praktyce

Zacznijmy od podstaw chłodzenia.

Wszystko, co jest zasilane energią elektryczną, generuje ciepło. W przypadku urządzeń domowych ilość tego ciepła jest zazwyczaj niewielka i rzadko wymaga specjalistycznych rozwiązań - inżynierowie polegają tu na chłodzeniu pasywnym, czyli naturalnym oddawaniu ciepła poprzez przepływ powietrza, co formalnie nazywamy konwekcją.

W rzadkich przypadkach (z wyłączeniem komputerów, smartfonów i laptopów) urządzenia domowe mogą posiadać niewielki wentylator - przykładem może być pistolet do masażu.

Główne wyjątki w gospodarstwie domowym to klimatyzatory i lodówki. W ich przypadku chłodzenie pasywne czy proste wentylatory są niewystarczające. Urządzenia te nie ograniczają się do oddawania ciepła - one aktywnie usuwają je z zamkniętej przestrzeni w celu utrzymania stałej, niskiej temperatury.

Tu do gry wchodzą czynniki chłodnicze: specjalistyczne substancje krążące w zamkniętym obiegu, które absorbują ciepło wewnątrz urządzenia i oddają je na zewnątrz. Dlatego lodówki czasem generują charakterystyczny dźwięk (sprężarka kompresuje czynnik) i są ciepłe z zewnątrz (skraplacz emituje ciepło). Wszystko to stanowi element tzw. termodynamicznego cyklu chłodniczego.

Wracając do naszego ulubionego tematu: serwerów.

Wykorzystują one kombinację chłodzenia pasywnego (radiatory), wymuszonego obiegu powietrza (wentylatory) oraz systemów zbliżonych do rozwiązań chłodniczych - chillerów lub systemów chłodzenia cieczą z przemianą fazową. Chłodzenie może być skierowane bezpośrednio na serwer (jego komponenty) lub na otoczenie, za co zazwyczaj odpowiadają systemy klimatyzacji precyzyjnej.

Omówimy każde z tych podejść - włączając w to rozwiązania wysoce niekonwencjonalne. Przejdziemy od metod podstawowych do ekstremalnych (tak, obiecana wrząca woda pojawi się na końcu).

Chłodzenie pasywne i powietrzne: PUE 1,5–2,0

Niski koszt początkowy, ale słaba wydajność i niska efektywność

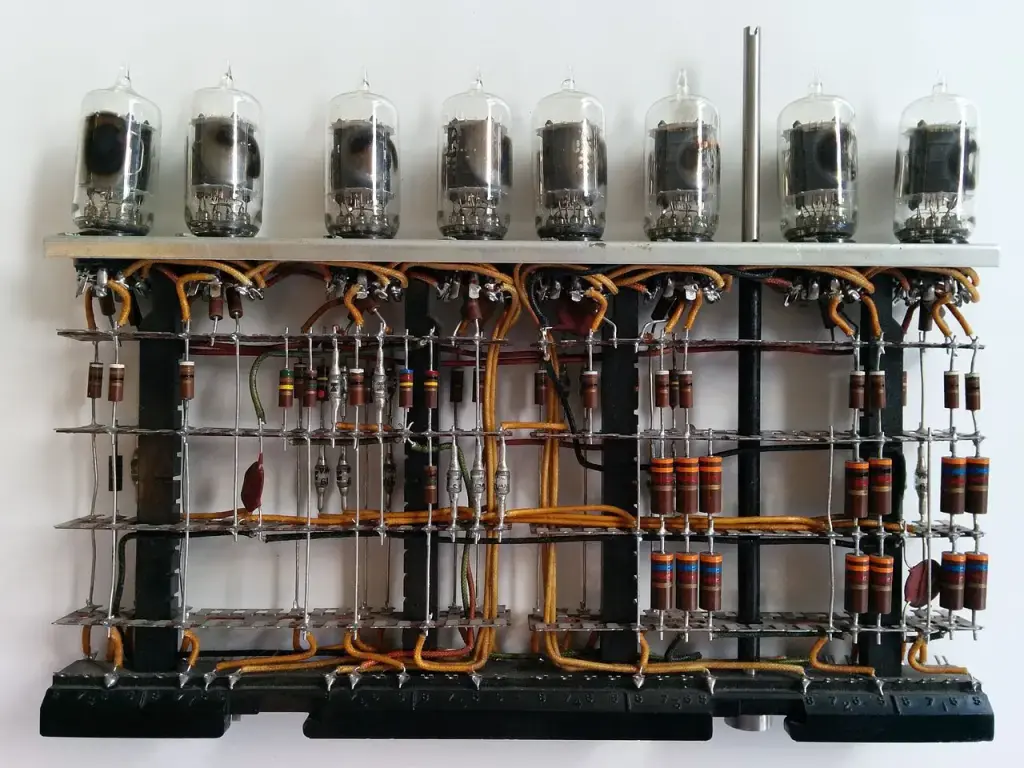

W czasach pionierskich komputerów - takich jak ENIAC, IBM 701 i podobnych maszyn z lat 40. i 50. - aktywne chłodzenie praktycznie nie istniało. Wystarczała naturalna konwekcja oraz podstawowa wentylacja pomieszczeń.

Warto zauważyć, że maszyny te generowały dziesiątki kilowatów ciepła, jednak przy ówczesnej niskiej gęstości komponentów opartych na lampach próżniowych, problem ten rozwiązywano głównie poprzez odpowiednią architekturę i układ pomieszczeń.

W latach 60. upowszechnienie tranzystorów pozwoliło na radykalne zmniejszenie rozmiarów komputerów i ich podzespołów. To wydarzenie zapoczątkowało erę pierwszych systemów wyposażonych w chłodzenie aktywne. Jednostki typu mainframe, takie jak IBM System/360, korzystały już z wentylatorów, które szybko stały się standardem rynkowym.

W latach 80. nastąpiła globalna ekspansja komputerów osobistych. Systemy takie jak IBM PC wykorzystywały wentylatory zintegrowane w zasilaczach.

Z kolei Apple II bazował wyłącznie na chłodzeniu pasywnym; Steve Jobs sprzeciwiał się stosowaniu wentylatorów, argumentując, że „wentylator w komputerze narusza zasady Zen i dekoncentruje użytkownika”. Podobne podejście zastosował w modelu Apple III - co skutkowało przewidywalnymi problemami z przegrzewaniem się jednostek.

Z czasem procesory stawały się coraz bardziej obciążone termicznie. Pod koniec dekady niektóre modele wymagały już stosowania radiatorów. Legendarny Intel 80486 - a zwłaszcza wysoko taktowany 486 DX2-66 - był jednym z pierwszych procesorów, które bezwzględnie wymagały aktywnego chłodzenia (zestawu radiatora i wentylatora).

I od tego momentu technologia chłodzenia rozwijała się konsekwentnie…

Chłodzenie powietrzem osiągnęło swoje apogeum na początku lat 2000. To wówczas pojawiły się zaawansowane konstrukcje: rurki cieplne (heatpipes), miedziane radiatory, wysokoobrotowe wentylatory oraz standardowe dziś układy zimnych i gorących korytarzy (hot-aisle / cold-aisle) w centrach danych, gdzie serwery zasysają chłodne powietrze z przodu i odprowadzają gorące tyłem.

Chłodzenie powietrzem zaczęto również integrować z rozwiązaniami cieczowymi - zestawami AIO (All-in-One) oraz pętlami niestandardowymi (custom loops) - szczególnie w systemach o wysokiej wydajności i jednostkach przetaktowanych.

Ciekawostka: w rozwiązaniach serwerowych procesory zazwyczaj nie posiadają indywidualnych wentylatorów. Zamiast tego strumień powietrza jest precyzyjnie kierowany za pomocą kanałów (shroudów) i tłoczony bezpośrednio przez radiatory zamontowane na CPU.

Od tego czasu chłodzenie powietrzem pozostaje dominującym rozwiązaniem - zarówno w segmencie PC, jak i serwerowym - co wynika z niskich kosztów, względnej niezawodności oraz prostoty konstrukcji. Nie jest ono jednak pozbawione wad. Wraz ze wzrostem gęstości upakowania komponentów w szafach rack, jego efektywność drastycznie spada. Hałas generowany przez wentylatory bywa uciążliwy (dlatego praca bezpośrednio przy serwerach nie należy do komfortowych). Gromadzenie się pyłu wymusza regularną konserwację lub stosowanie zaawansowanej filtracji, co w skali centrów danych przekłada się na konieczność posiadania potężnych systemów HVAC.

Z drugiej strony, nawet tę wadę można zamienić w zaletę: ciepło odpadowe da się odzyskiwać i ponownie wykorzystywać - na przykład do ogrzewania biur albo nawet pobliskich budynków mieszkalnych.

Chłodzenie powietrzem w serwerach ≠ chłodzenie PC

Model chłodzenia powietrznego w serwerach znacząco odbiega od standardów znanych z komputerów stacjonarnych. Większość serwerów to płaskie systemy o wysokości 1U lub 2U (gdzie 1U = 44,45 mm), co uniemożliwia montaż standardowych wentylatorów 120 mm. Z powodu ograniczonej przestrzeni, powietrze jest przetaczane przez wąskie kanały, co wymusza wysoką prędkość przepływu i generuje dużą turbulencję.

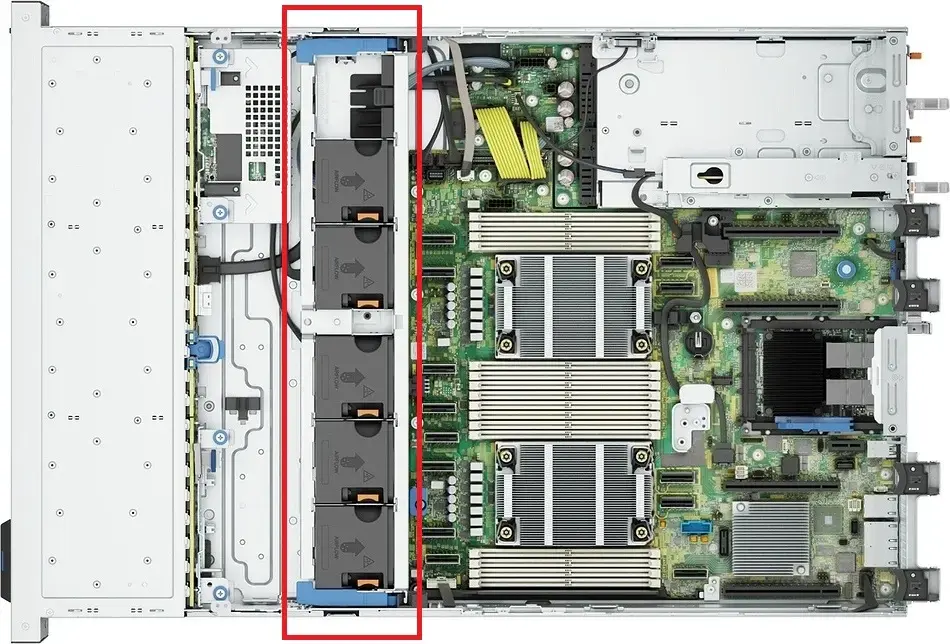

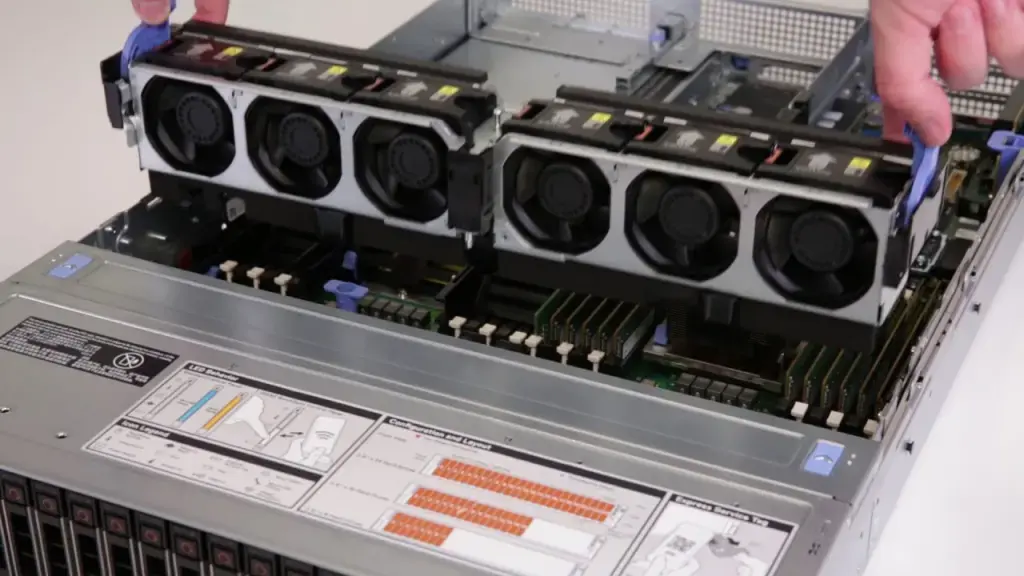

Doświadczeni administratorzy mogą pamiętać moduły chłodzenia takie jak ten:

Duży, 120-milimetrowy wentylator odśrodkowy (blower) pośrodku, flankowany przez dwa mniejsze wentylatory po bokach.

Dziś jednak większość serwerów korzysta z kompaktowych wentylatorów o bardzo wysokich obrotach - zazwyczaj 40×40 mm lub 60×60 mm. W większych systemach (4U i wyższych) czasem spotyka się większe wentylatory. Typowe prędkości mieszczą się w zakresie 10 000–20 000 obr./min, a czasem nawet więcej.

Stąd bierze się słynny hałas serwerów. Można go określić jako „odrzutowy”: im mniejsze łopatki wentylatora, tym głośniejszy i bardziej piskliwy dźwięk (wraz z częstotliwością drgań).

Systemy chłodzenia cieczą (LCS)

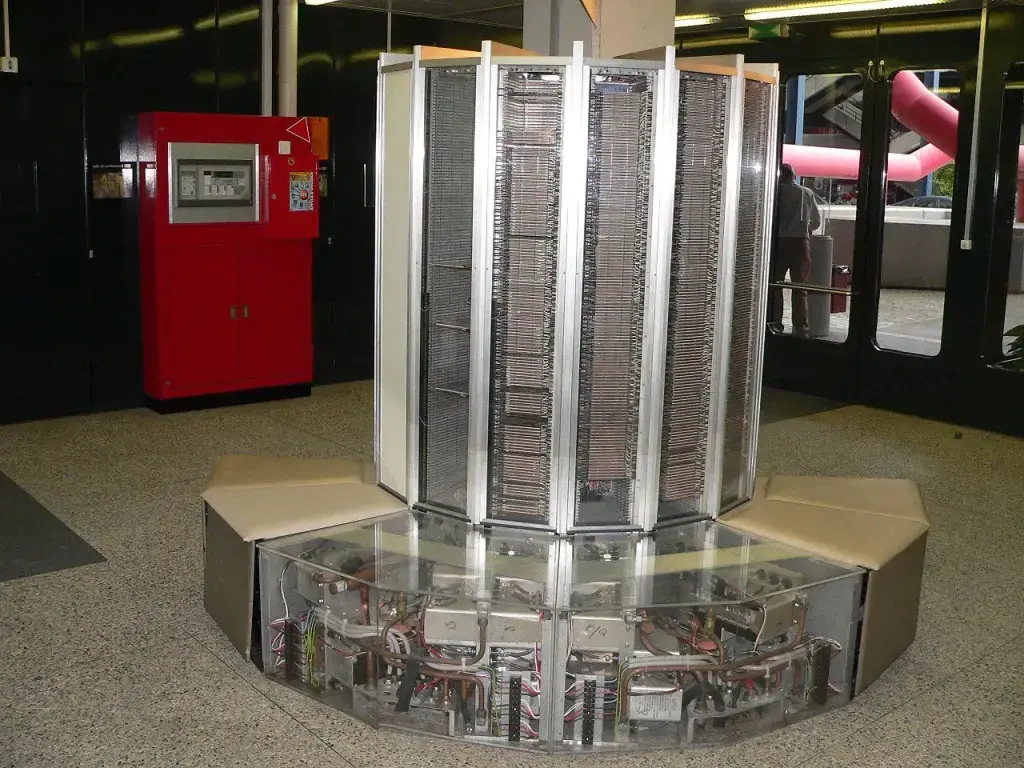

Pierwsze eksperymenty z chłodzeniem cieczą w elektronice sięgają lat 80. Wydzielanie ciepła przez procesory rosło bardzo szybko, a inżynierowie szukali alternatyw. W latach 90. koncepcja zaczęła być komercyjnie opłacalna. Przykładowo, superkomputery Cray wykorzystywały chłodzenie cieczą z rurkami wypełnionymi freonem do odprowadzania ciepła.

Mechanizm był podobny do domowej lodówki i opierał się na efekcie Joule’a–Thomsona: temperatura czynnika chłodniczego spada wraz ze spadkiem ciśnienia podczas przepływu przez wąski odcinek rurki.

Ściśle rzecz biorąc, był to system dwufazowego chłodzenia cieczą (albo po prostu chiller), ponieważ czynnik zmieniał stan skupienia. Jak można się domyślić, rozwiązanie to było duże, skomplikowane i drogie - daleko poza zasięgiem zwykłych użytkowników.

Lata 2000: chłodzenie cieczą wchodzi do głównego nurtu

Prawdziwy rozkwit tej technologii nastąpił w latach 2000., gdy entuzjaści overclockingu i gracze zaczęli budować własne układy składające się z pomp, węży, bloków wodnych oraz chłodnic.

W tamtym okresie instalacja chłodzenia cieczą na CPU lub GPU nie była dostępna dla każdego. Ściślej mówiąc: niemal każdy mógł podjąć taką próbę, lecz niewielu powinno było to robić. Była to dziedzina ocierająca się o sztukę, a dla wielu - pasja wymagająca specjalistycznej wiedzy.

Proces był skomplikowany, kosztowny i obarczony ryzykiem. Wyciek mógł zabić system w kilka sekund, spowodować zwarcie lub - w najgorszym przypadku - pożar.

Dlatego w latach 2010. ogromną popularność zdobyły zestawy AIO (All-in-One). Wstępnie zmontowane, szczelnie zamknięte układy, takie jak Corsair H100 czy NZXT Kraken, sprawiły, że chłodzenie cieczą stało się dostępne dla mas. Nagle każdy, kto potrafił złożyć PC, mógł zainstalować chłodzenie wodne w domu.

I tak - pojawiały się też naprawdę dzikie eksperymenty konsumenckie z czynnikami chłodniczymi.

Ciekawostka: niektóre systemy wykorzystują specjalne ciecze dielektryczne, które nie przewodzą prądu, zmniejszając ryzyko uszkodzeń w razie wycieku.

Chłodzenie cieczą w serwerach: New Game+, PUE 1,15–1,35

Direct Liquid Cooling (DLC) - znane także jako Direct-to-Chip (D2C) - to metoda usuwania ciepła z komponentów serwera (CPU, GPU i innych) poprzez bezpośredni kontakt z cieczą chłodzącą.

Systemy DLC mogą być jedno- lub dwufazowe, ale zasada pozostaje ta sama: ciecz odbiera ciepło bezpośrednio z najgorętszych komponentów. Układ działa w obiegu zamkniętym, w którym chłodziwo dosłownie „kąpie” CPU i GPU za pośrednictwem metalowych płyt stykowych (cold plates) montowanych bezpośrednio na hotspotach. Płyty te działają jak termiczne gąbki, pochłaniając energię.

Podgrzana ciecz trafia następnie do CDU (Coolant Distribution Unit) - serca systemu - gdzie ciepło przekazywane jest do głównego obiegu chłodzenia obiektu. Co dzieje się dalej, zależy od inżynierskiej kreatywności: odzysk ciepła (łącznie z podłączeniem do sieci ciepłowniczej), integracja z obiegiem zimnej wody, wyparne wieże chłodnicze (estetyka rodem z elektrowni jądrowej) albo proste dry coolery.

Po schłodzeniu ciecz wraca do układów - coś w rodzaju naturalnego obiegu wody w skali serwerowni.

Chłodzenie bezpośrednie cieczą jest obecnie rozwiązaniem priorytetowym w serwerach o wysokiej gęstości, wyposażonych w flagowe procesory i akceleratory AI, które generują potężne ilości ciepła. Przykładowo, Nvidia H100 charakteryzuje się TDP na poziomie 700 W, natomiast nadchodząca Nvidia B200 osiąga pułap 1000 W. Nowoczesne procesory Intel Xeon oraz AMD EPYC rutynowo emitują po 300–400 W każdy.

Należy pamiętać, że w dużych centrach danych pracują tysiące takich jednostek. W tej skali powietrze przestaje być skutecznym medium transmisyjnym dla ciepła, szczególnie w gęsto upakowanych szafach rack, gdzie optymalizacja przestrzeni jest kluczowa.

Krótka uwaga: TDP

TDP (Thermal Design Power) to parametr określający maksymalną ilość ciepła, jaką układ (CPU, GPU) generuje podczas pracy z częstotliwością bazową - bez uwzględnienia trybów turbo oraz modyfikacji użytkownika. Parametr ten służy przede wszystkim do poprawnego doboru systemu chłodzenia: wyższa wartość TDP determinuje konieczność zastosowania wydajniejszego radiatora lub coolera.

Kilka ważnych niuansów:

-

TDP nie jest równoznaczne z rzeczywistym poborem mocy. Procesory mogą istotnie przekraczać tę wartość podczas krótkotrwałych skoków wydajności (boost).

-

Producenci liczą TDP w różny sposób - Intel i AMD stosują odmienne metodologie, więc bezpośrednie porównania nie zawsze są precyzyjne.

-

Wskaźnik ten jest szczególnie krytyczny w urządzeniach mobilnych (smartfony, laptopy), gdzie kumulacja ciepła z sąsiednich podzespołów prowadzi do zjawiska throttlingu (ograniczania wydajności). Duże obudowy standardu ATX są pod tym względem znacznie bardziej tolerancyjne.

Dlaczego DLC ma znaczenie

Technologia DLC (Direct Liquid Cooling) pozwala centrom danych na zwiększenie zagęszczenia sprzętu na tej samej powierzchni użytkowej, przy jednoczesnej redukcji zużycia energii o 30–50%. Systemy te charakteryzują się cichszą pracą oraz znacznie mniejszą zależnością od temperatury otoczenia, co czyni je idealnym rozwiązaniem dla obiektów zlokalizowanych w gorącym klimacie. Dodatkowo, ograniczenie przepływu powietrza redukuje akumulację pyłu, co obniża wymagania dotyczące czystości powietrza w halach serwerowych.

Oczywiście są też wady. Instalacja i wdrożenie są kosztowne (choć często z czasem się zwracają dzięki oszczędnościom energii - pod warunkiem uwzględnienia lokalnych cen prądu). DLC wymaga dodatkowej infrastruktury: radiatorów, pomp, wymienników ciepła. Nie każdy budynek się do tego nadaje. I choć nowoczesne systemy są bardzo bezpieczne, ryzyko wycieku nigdy nie spada do zera.

Patrząc szerzej: DLC to przyszłość chłodzenia serwerów w centrach danych. Wraz ze wzrostem gęstości sprzętu i dominacją obciążeń AI zapotrzebowanie na tę technologię będzie tylko rosło. Nadal jest droga, ale już powszechnie stosowana przez big tech - Google, Microsoft, Amazon, Meta, Tencent - i stopniowo trafia do małych i średnich firm, szczególnie w regionach z drogą energią elektryczną, gdzie zwrot z inwestycji trudno zignorować.

Co jest rozwijane teraz: chłodzenie kapilarne wewnątrz CPU

A co, gdyby system chłodzenia zintegrować bezpośrednio z procesorem?

Branża prowadzi zaawansowane testy z mikrokanalikami trawionymi bezpośrednio w strukturze krzemowej, co pozwala cieczy chłodzącej przepływać w bezpośrednim sąsiedztwie rdzeni obliczeniowych. Minimalizacja liczby warstw między źródłem ciepła a chłodziwem drastycznie redukuje opór cieplny i przyspiesza transfer energii.

Mimo że koncepcja brzmi obiecująco, niesie ze sobą wyzwania: fluktuacje ciśnienia w systemie mogą prowadzić do powstawania lokalnych hotspotów i gwałtownych skoków temperatury.

Naukowcy z firmy Microsoft zaproponowali rozwiązanie inspirowane biologią, projektując mikrokanaliki na wzór układu naczyniowego. Obszary o wyższej emisji ciepła otrzymują większą dawkę chłodziwa. Efekty są imponujące: odnotowano spadek temperatury maksymalnej o 18°C, redukcję ciśnienia w systemie o 67% oraz trzykrotne zmniejszenie różnic temperatur między poszczególnymi rdzeniami.

Co najważniejsze, metoda ta jest w pełni kompatybilna z technologią CMOS, stanowiącą fundament współczesnej produkcji układów scalonych. Mikrokanaliki mogą być integrowane z procesorem już na etapie produkcji. W przyszłości chłodzenie może przestać być komponentem zewnętrznym, stając się integralną częścią samego procesora.

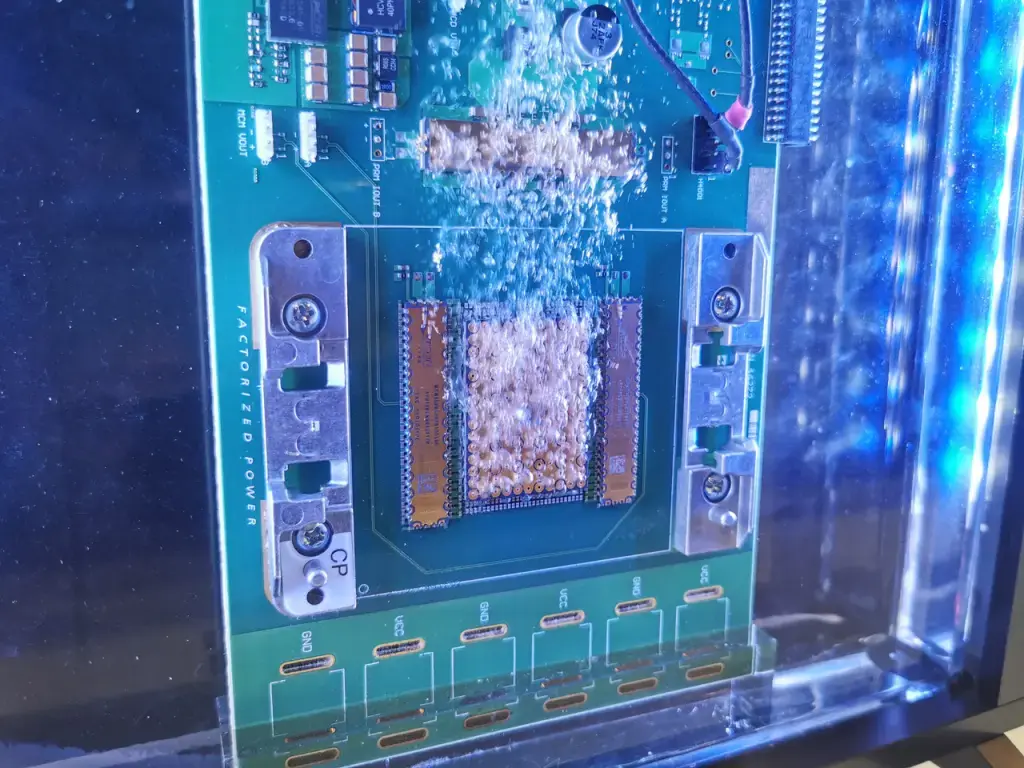

Nadal nic nie wrze? Chłodzenie zanurzeniowe nadchodzi

PUE ≈ 1,03–1,10

Chłodzenie zanurzeniowe oznacza dokładnie to, co sugeruje nazwa: serwer jest całkowicie zanurzony w cieczy w celu bezpośredniej wymiany ciepła (istnieją też koncepcje częściowego zanurzenia). Zamiast tłoczyć chłodziwo skomplikowaną siecią rurek do wybranych elementów, zanurzamy całą jednostkę w medium przewodzącym ciepło.

Wizualnie przypomina to trochę frytkownicę dla serwerów. Zbiornik może nawet zawierać olej - ale nie taki, na którym coś byście usmażyli. Frytek tu nie będzie.

Standardowa woda jest wykluczona (nawet woda destylowana z czasem zyskuje przewodność). Systemy te wykorzystują zaawansowane ciecze syntetyczne, oleje mineralne lub związki fluorowęglowodorowe. Są one dielektrykami (bezpiecznymi dla elektroniki), charakteryzują się wysoką pojemnością cieplną i doskonale odprowadzają energię z komponentów.

I właśnie tutaj wreszcie dochodzimy do chłodzenia serwerów wrzącą cieczą.

Ale to…

omówimy w przyszłym tygodniu.