Un saluto ai nostri lettori abituali… e a chi è appena capitato qui!

Cosa avete sentito sulle ultime tendenze nel raffreddamento dei server? Raffreddamento a liquido, forse? Data center installati nell’oceano?

Tutto questo è senza dubbio affascinante. Ma se il titolo sui server immersi in acqua bollente ha attirato la vostra attenzione; se non avete mai sentito parlare dell’uso di acqua potabile per il raffreddamento, se non avete idea di cosa sia il raffreddamento capillare delle CPU e il termine PUE per voi non significa assolutamente nulla… allora siete nel posto giusto.

In questo articolo vi guiderò attraverso il modo in cui l’industria del raffreddamento dei server si sta adattando a chip il cui TDP corre verso la soglia dei 1000 watt.

Avvertenza: lettura lunga in arrivo.

Prendete un thermos con tè, caffè o qualcosa di più forte… così non vi raffreddate 🙂

Tutti vogliono un PUE più basso

Il PUE (Power Usage Effectiveness) è la metrica più utilizzata nel settore dei data center per misurare l’efficienza energetica dell’infrastruttura. È ottima per monitorare l’evoluzione di un singolo data center nel tempo e per valutare l’impatto di diverse decisioni: cambio dei sistemi di raffreddamento, riconfigurazione delle apparecchiature e così via.

Funziona al meglio quando viene applicata a una struttura specifica, aiutando a capire quali soluzioni migliorano davvero l’efficienza energetica nella pratica.

La metrica è stata introdotta nel 2007 da The Green Grid (TGG), un consorzio industriale no-profit focalizzato sul miglioramento dell’efficienza delle risorse nei data center. Tra i suoi membri ci sono — o ci sono stati — praticamente tutti i grandi nomi dell’hardware server, dei componenti, del software e dei servizi cloud: AMD, Nvidia, Dell, HPE, IBM, Intel, Microsoft, Google, Cisco, Oracle, AWS e molti altri.

La formula del PUE è semplice:

PUE = Potenza totale del sito / Potenza delle apparecchiature IT

Per apparecchiature IT si intende tutto ciò che esegue calcolo vero e proprio: server, sistemi di storage, apparati di rete, più dispositivi ausiliari come switch KVM, monitor e workstation o laptop usati per il monitoraggio o la gestione del data center.

La potenza totale del sito comprende tutto ciò che la struttura consuma: apparecchiature IT più componenti di distribuzione dell’energia, sistemi UPS, quadri elettrici, generatori, PDU, batterie e tutte le perdite energetiche al di fuori dell’IT stesso. A questo si aggiungono i sistemi di raffreddamento — chiller, torri di raffreddamento, pompe, unità CRAC (Computer Room Air Conditioning), sistemi DX (Direct Expansion) — e il mio acronimo preferito per confondere le idee: le unità CRAH (Computer Room Air Handling). Inoltre ci sono i carichi secondari come l’illuminazione, i sistemi di controllo accessi e altre infrastrutture dell’edificio.

In teoria, il PUE perfetto è 1,0. Significherebbe che il 100% dell’energia va al calcolo e zero all’infrastruttura (raffreddamento, illuminazione e tutto il resto). Nella realtà tale valore è irraggiungibile. Ma più il PUE è basso, meglio è.

È un po’ come cercare di raggiungere la velocità della luce nei viaggi spaziali: ci si può avvicinare sempre di più, ma qualsiasi oggetto con massa diversa da zero non ci arriverà mai davvero.

Se prendiamo un PUE quasi da fantascienza di 1,03, significa che per ogni 100 watt usati per il calcolo, il data center ne consuma solo 3 per tutto il resto.

E il principale ostacolo alla riduzione del PUE? Il raffreddamento.

Il solo raffreddamento può rappresentare fino al 40–50% del consumo energetico totale di una struttura. Con i sistemi tradizionali basati sull’aria si è spesso più vicini al limite superiore, intorno al 50%. Il raffreddamento a liquido o il free cooling possono ridurre questa quota al 20–30%, o anche meno in condizioni favorevoli.

Parliamo quindi delle soluzioni specifiche utilizzate per ridurre il PUE dal punto di vista del raffreddamento.

Spoiler: ce ne sono molte, e dipendono tutte dall’età e dalle dimensioni della struttura, dalle apparecchiature utilizzate, dalla posizione geografica, dai livelli di utilizzo e da molti altri fattori.

Raffreddare l’hardware

Partiamo dalle basi del raffreddamento.

Qualsiasi cosa funzioni con l’elettricità genera calore. Negli elettrodomestici questo calore è solitamente ridotto e raramente richiede misure speciali; gli ingegneri si affidano in genere al raffreddamento passivo, cioè alla dissipazione naturale del calore tramite il flusso d’aria, o più formalmente, la convezione.

In rari casi (escludendo PC, smartphone e laptop), alcuni dispositivi domestici hanno una piccola ventola, come quella del mio massaggiatore a percussione.

Le principali eccezioni in casa sono i condizionatori e i frigoriferi. Il raffreddamento passivo o un paio di ventole non bastano. Questi dispositivi non si limitano a dissipare calore, ma lo rimuovono attivamente da uno spazio chiuso per mantenere una temperatura costantemente bassa.

Qui entrano in gioco i refrigeranti: sostanze speciali che circolano in un circuito chiuso, assorbono calore all’interno del frigorifero o del climatizzatore e lo rilasciano all’esterno. È per questo che i frigoriferi a volte ronzano (il compressore sta comprimendo il refrigerante) e risultano caldi all’esterno (le serpentine del condensatore stanno cedendo calore). Tutto ciò fa parte di quello che viene chiamato ciclo di refrigerazione termodinamico.

Torniamo ora al nostro argomento preferito: i server.

I server utilizzano una combinazione di raffreddamento passivo (dissipatori), ventole e sistemi simili a quelli dei frigoriferi: chiller o sistemi di raffreddamento a liquido con cambio di fase. Il raffreddamento può essere applicato direttamente al server (ai componenti al suo interno) oppure all’ambiente circostante, che viene normalmente gestito da sistemi di condizionamento.

Coprirò tutti questi approcci, inclusi alcuni piuttosto non convenzionali. Andremo dal semplice all’estremo (sì, l’acqua bollente arriva alla fine).

Raffreddamento passivo e ad aria: PUE 1,5–2,0

Costo iniziale basso, ma prestazioni deboli e scarsa efficienza

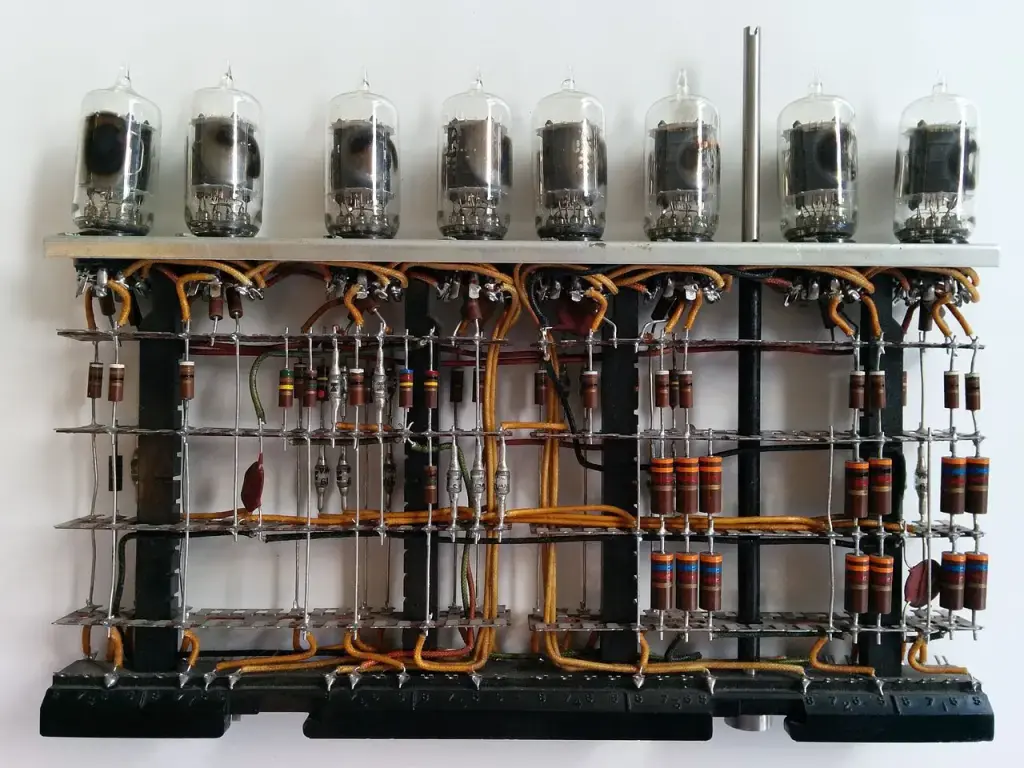

All’epoca dei primi computer elettronici — ENIAC, IBM 701 e macchine simili degli anni ’40 e ’50 — non esisteva il raffreddamento attivo. La convezione naturale e una ventilazione di base degli ambienti erano sufficienti.

Sì, queste macchine generavano decine di kilowatt di calore. Ma la densità dei componenti era bassa — tutto era costruito con valvole termoioniche — quindi il problema poteva essere risolto tramite la disposizione degli spazi e l’architettura delle stanze.

Negli anni ’60 arrivarono i transistor, che ridussero drasticamente le dimensioni dei computer e dei loro componenti. Fu l’inizio dell’era dei primi sistemi raffreddati attivamente. I mainframe come l’IBM System/360 facevano già affidamento sulle ventole, che divennero presto lo standard.

Negli anni ’80 i personal computer iniziarono la loro conquista globale. Sistemi come l’IBM PC utilizzavano ventole negli alimentatori.

L’Apple II, invece, si affidava interamente al raffreddamento passivo. Steve Jobs rifiutava le ventole perché, a suo dire, “una ventola dentro un computer viola i principi Zen e distrae dal lavoro”. Applicò un approccio simile anche all’Apple III, con prevedibili problemi di surriscaldamento.

Col tempo le CPU iniziarono a scaldarsi sempre di più. Alla fine del decennio, alcuni modelli richiedevano dissipatori. Il leggendario Intel 80486 — in particolare le versioni ad alta frequenza come il 486 DX2-66 — fu tra le prime CPU ad avere davvero bisogno di un sistema di raffreddamento (un dissipatore con ventola).

Da lì in poi, la tecnologia di raffreddamento evolse costantemente…

A mio avviso, il raffreddamento ad aria ha raggiunto il suo apice all’inizio degli anni 2000. È stato il periodo dei design sempre più sofisticati: heat pipe, dissipatori in rame, ventole ad alto numero di giri e le ormai standard configurazioni hot aisle / cold aisle nelle sale server e nei data center (i server aspirano aria fredda dalla parte frontale ed espellono aria calda dal retro).

Il raffreddamento ad aria ha iniziato anche a essere affiancato da soluzioni a liquido — sistemi AIO (All-in-One) e circuiti personalizzati — soprattutto nei sistemi ad alte prestazioni e nelle configurazioni overclockate.

Curiosità: nei server, le CPU di solito non hanno dissipatori individuali. Il flusso d’aria viene invece canalizzato con precisione e spinto direttamente attraverso i dissipatori montati sui processori.

Da allora, il raffreddamento ad aria è rimasto l’approccio più comune sia per i PC che per i server. Deve la sua popolarità al costo contenuto, alla relativa affidabilità e alla semplicità. Ma è tutt’altro che perfetto. L’efficienza diminuisce all’aumentare della densità dei componenti o dei rack. Il rumore delle ventole può essere davvero fastidioso (motivo per cui i server stanno nelle sale server: lavorarci accanto non è esattamente piacevole). L’accumulo di polvere richiede pulizia regolare o filtrazione dell’aria, e nei data center questo si traduce in sistemi HVAC potenti.

Detto questo, anche questo svantaggio può diventare un vantaggio: il calore di scarto può essere recuperato e riutilizzato, ad esempio per riscaldare uffici o persino edifici residenziali vicini.

Raffreddamento ad aria nei server ≠ raffreddamento ad aria nei PC

Il raffreddamento ad aria nei server è piuttosto diverso da quello dei PC desktop. La maggior parte dei server è costituita da sistemi piatti da 1U o 2U (dove 1U equivale a 44,45 mm di altezza), il che non lascia spazio per le classiche ventole da 120 mm. Con lo spazio ridotto al minimo, l’aria viene forzata attraverso canali stretti, creando velocità di flusso elevate e molta turbolenza.

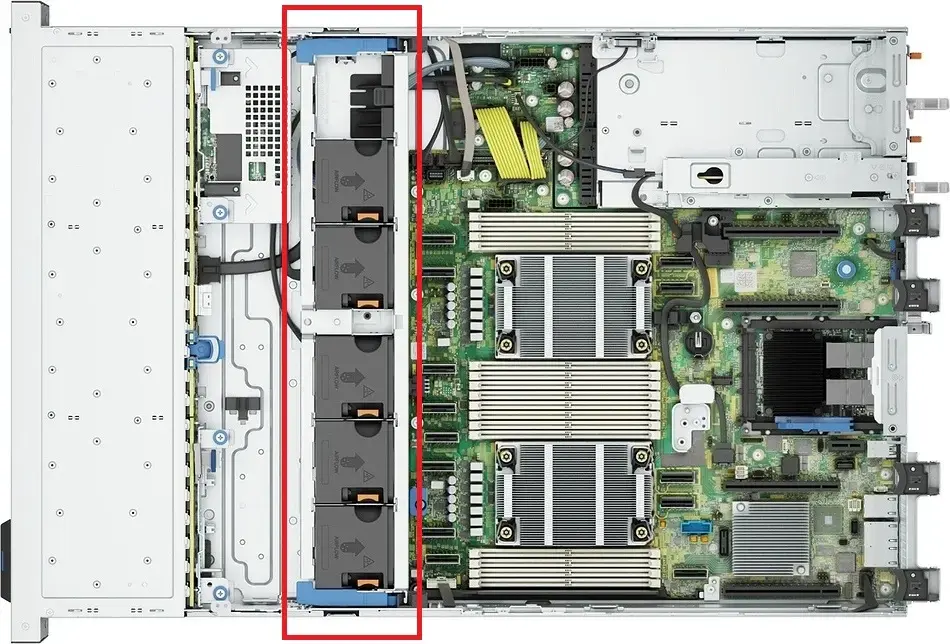

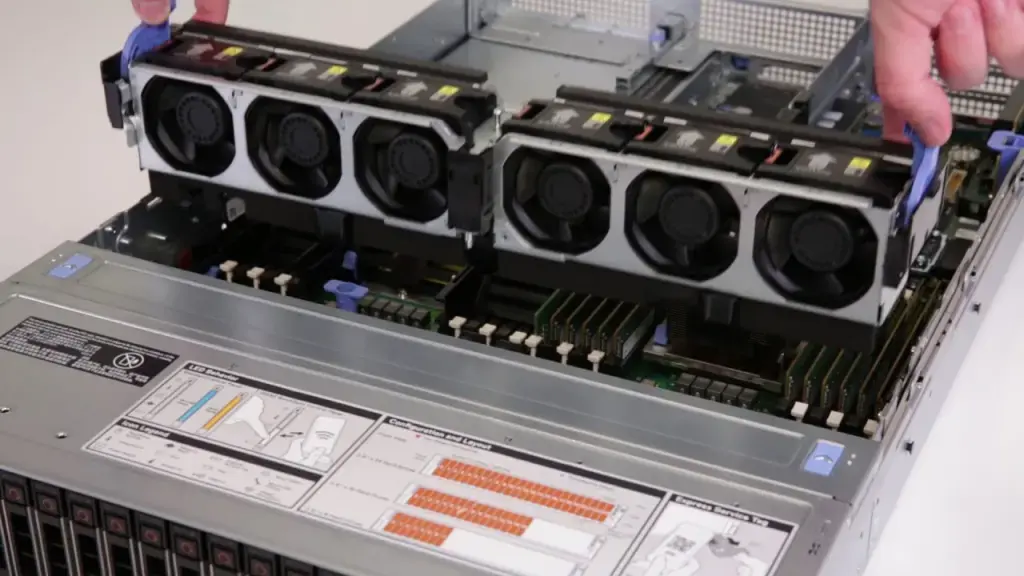

I sysadmin più esperti potrebbero ricordare moduli di raffreddamento come questo:

Una grande ventola centrifuga da 120 mm al centro, affiancata da due ventole più piccole ai lati.

Oggi, però, la maggior parte dei server utilizza ventole compatte ad alto numero di giri, tipicamente da 40×40 mm o 60×60 mm. Nei sistemi più grandi (4U e oltre) si vedono talvolta ventole più grandi. Le velocità tipiche vanno dai 10.000 ai 20.000 giri al minuto, a volte anche di più.

È da qui che nasce il famigerato rumore dei server. Si potrebbe definirlo “simile a un motore a reazione”: più piccole sono le pale, più il rumore è forte e acuto (insieme alla frequenza delle vibrazioni).

Sistemi di raffreddamento a liquido (LCS)

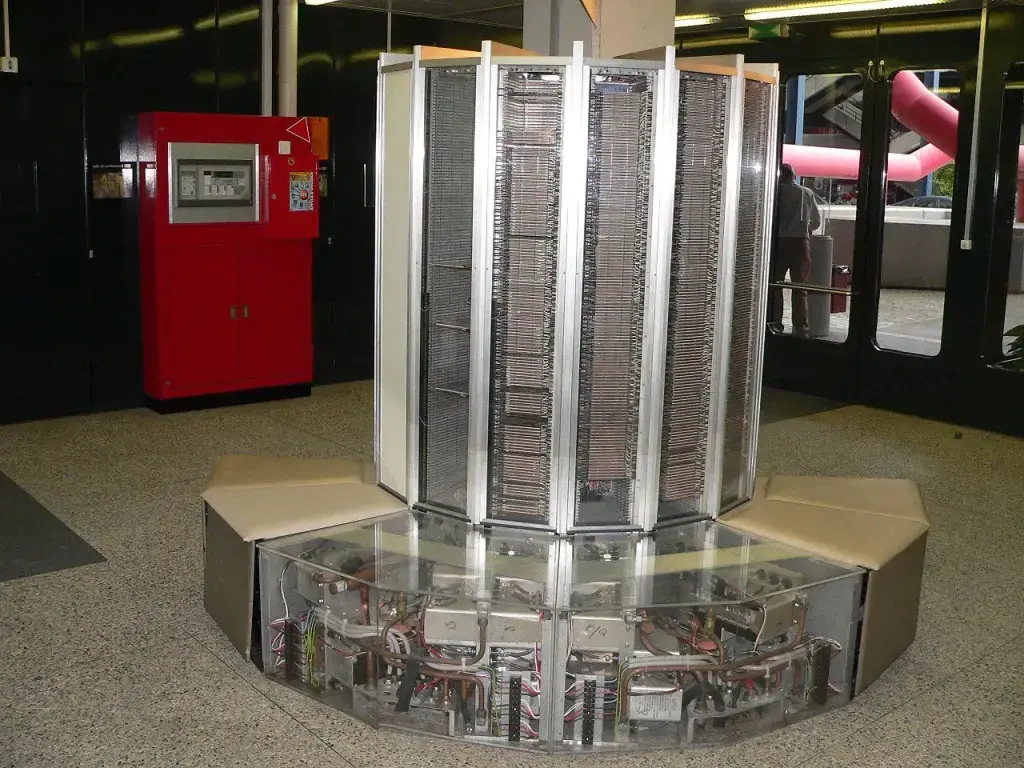

I primi esperimenti di raffreddamento a liquido per l’elettronica risalgono agli anni ’80. La potenza termica dei processori cresceva rapidamente e gli ingegneri cercavano alternative. Negli anni ’90 il concetto iniziò a diventare commercialmente praticabile. Ad esempio, i supercomputer Cray utilizzavano raffreddamento a liquido con tubazioni a base di Freon per rimuovere il calore.

Il meccanismo era simile a quello di un frigorifero domestico, basato sull’effetto Joule–Thomson: la temperatura del refrigerante diminuisce quando la pressione cala passando attraverso una sezione ristretta del tubo.

A rigor di termini, questa configurazione è più correttamente descritta come raffreddamento a liquido bifase (o semplicemente un chiller), poiché il refrigerante cambia stato. Come si può immaginare, la soluzione era ingombrante, complessa e costosa… ben oltre la portata degli utenti comuni.

Anni 2000: il raffreddamento a liquido diventa mainstream

Il vero boom arrivò negli anni 2000, quando overclocker, gamer ed энтузиasti hardware iniziarono a costruire circuiti personalizzati con pompe, tubi, waterblock e radiatori.

All’epoca non tutti potevano installare un sistema di raffreddamento a liquido su CPU o GPU. A essere precisi non tutti potevano, e pochissimi avrebbero dovuto provarci. Era quasi una forma d’arte e, per alcuni, un hobby o persino una professione.

Il processo era complesso, costoso e non privo di rischi. Una perdita poteva distruggere un sistema in pochi secondi, causare un cortocircuito o — nel peggiore dei casi — provocare un incendio.

È per questo che i sistemi AIO (All-in-One) hanno preso piede negli anni 2010. Circuiti preassemblati e sigillati come il Corsair H100 o l’NZXT Kraken hanno reso il raffreddamento a liquido accessibile al grande pubblico. All’improvviso, chiunque sapesse assemblare un PC poteva installare un raffreddamento a liquido in casa.

E sì, ci sono stati anche alcuni esperimenti consumer davvero estremi con refrigeranti.

Curiosità: alcuni sistemi utilizzano liquidi dielettrici speciali che non conducono elettricità, riducendo il rischio di danni in caso di perdita.

Raffreddamento a liquido per server: New Game+, PUE 1,15–1,35

Il Direct Liquid Cooling (DLC) — noto anche come Direct-to-Chip (D2C) — è un metodo per rimuovere il calore dai componenti dei server (CPU, GPU e altro) tramite contatto diretto con un liquido refrigerante.

I sistemi DLC possono essere monofase o bifase, ma il principio è lo stesso: il liquido assorbe il calore direttamente dai componenti più caldi. Il sistema funziona come un circuito chiuso, in cui il refrigerante “bagna” CPU e GPU attraverso piastre fredde metalliche montate direttamente sopra i punti più caldi. Queste piastre agiscono come spugne termiche, assorbendo energia.

Il liquido riscaldato viene poi inviato a una CDU (Coolant Distribution Unit) — il cuore del sistema — che trasferisce il calore al circuito di raffreddamento principale della struttura. Da lì in poi entra in gioco la creatività ingegneristica: recupero del calore (fino al teleriscaldamento di edifici vicini), collegamento a un circuito di acqua fredda, torri evaporative (con un’estetica da centrale nucleare) o semplici dry cooler.

Una volta raffreddato, il liquido torna ai chip in una sorta di ciclo naturale dell’acqua, ma all’interno delle sale server.

Il raffreddamento a liquido diretto è molto richiesto per server ad alta densità dotati di CPU di fascia alta e acceleratori AI che generano enormi quantità di calore. Per esempio, l’Nvidia H100 ha un TDP di 700 W, mentre il futuro Nvidia B200 è accreditato di un impressionante TDP di 1000 W. I moderni Intel Xeon e AMD EPYC dissipano regolarmente 300–400 W ciascuno.

E ricordate: nei grandi data center ci sono migliaia — a volte decine di migliaia — di questi chip, con più processori per server. A questa scala, l’aria semplicemente non riesce a rimuovere il calore abbastanza velocemente, soprattutto nei rack ad alta densità dove ogni centimetro conta.

Una breve nota

Il TDP (Thermal Design Power) è una metrica che descrive la quantità massima di calore che un processore, una GPU o un altro chip è previsto generi funzionando alla frequenza base, senza turbo boost o overclock dell’utente. Viene utilizzato principalmente per dimensionare una soluzione di raffreddamento: più alto è il TDP, più potente deve essere il dissipatore e/o il radiatore.

Alcune sfumature importanti:

-

Il TDP non è la stessa cosa del consumo energetico reale. Le CPU possono — e spesso lo fanno — superare il TDP nominale per brevi periodi durante il boost.

-

I produttori calcolano il TDP in modo diverso: Intel e AMD utilizzano metodologie differenti, quindi i confronti diretti non sono sempre accurati.

-

Il TDP è particolarmente critico nei dispositivi compatti come smartphone e laptop, dove il calore dei componenti vicini può causare rapidamente surriscaldamento e throttling. I grandi case ATX, invece, sono molto più tolleranti a piccole deviazioni.

Perché il DLC è importante

Il raffreddamento a liquido diretto consente ai data center di installare più apparecchiature nello stesso spazio riducendo al contempo il consumo energetico del 30–50%. Questi sistemi sono più silenziosi — ideali per uffici e sale server onsite — e molto meno dipendenti dalla temperatura dell’aria ambiente, il che li rende particolarmente interessanti nei climi caldi. Inoltre accumulano meno polvere, riducendo i requisiti di qualità dell’aria per l’ambiente.

Naturalmente, ci sono anche degli svantaggi. L’installazione e il deployment sono costosi (anche se spesso compensati nel tempo dal risparmio energetico, soprattutto considerando il prezzo locale dell’elettricità). Il DLC richiede infrastrutture aggiuntive: radiatori, pompe, scambiatori di calore. Non tutti gli edifici sono adatti. E sebbene i sistemi moderni siano molto sicuri, il rischio di perdite non è mai pari a zero.

Se allarghiamo lo sguardo: il DLC è il futuro del raffreddamento dei server nei data center. Con l’aumento della densità hardware e la diffusione dei carichi di lavoro IA, la domanda di questa tecnologia non potrà che crescere. È ancora costosa, ma è già ampiamente utilizzata dai big tech — Google, Microsoft, Amazon, Meta, Tencent — e sta gradualmente arrivando anche nelle piccole e medie imprese, soprattutto nelle regioni con elettricità costosa, dove il ritorno sull’investimento è difficile da ignorare.

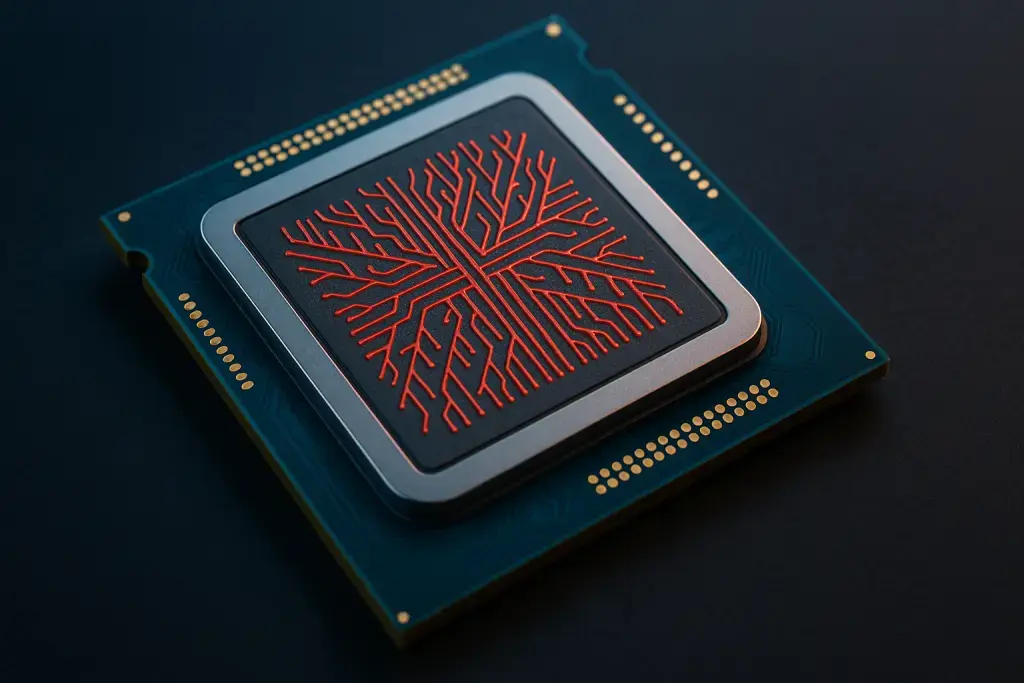

Cosa si sta sviluppando ora: raffreddamento capillare all’interno della CPU

E se il raffreddamento vivesse direttamente dentro il processore?

Il settore sta sperimentando microcanali incisi direttamente nel silicio, che permettono al refrigerante di scorrere a contatto quasi diretto con il die. Meno strati tra la fonte di calore e il liquido significano minore resistenza termica e una rimozione del calore molto più rapida.

Sembra perfetto. Ma, come sempre, c’è un problema: le fluttuazioni di pressione all’interno del sistema possono creare hotspot e forti oscillazioni di temperatura.

I ricercatori di Microsoft hanno deciso di prendere in prestito un’idea dalla biologia. Hanno progettato microcanali che imitano un sistema circolatorio: arterie, vene, capillari. Le zone più calde del chip ricevono più refrigerante, quelle più fredde meno. I risultati sono impressionanti: la temperatura di picco è diminuita di 18 °C, la pressione del sistema si è ridotta del 67% e la variazione di temperatura tra i core è stata ridotta di un fattore tre.

La parte migliore? Questo approccio è compatibile con la tecnologia CMOS (Complementary Metal-Oxide-Semiconductor), la base della produzione moderna di chip. Questi microcanali possono essere incisi direttamente nel silicio durante la fabbricazione e integrati nei processori contemporanei. In futuro, il raffreddamento potrebbe non essere più un sistema esterno, ma diventare parte integrante del chip stesso.

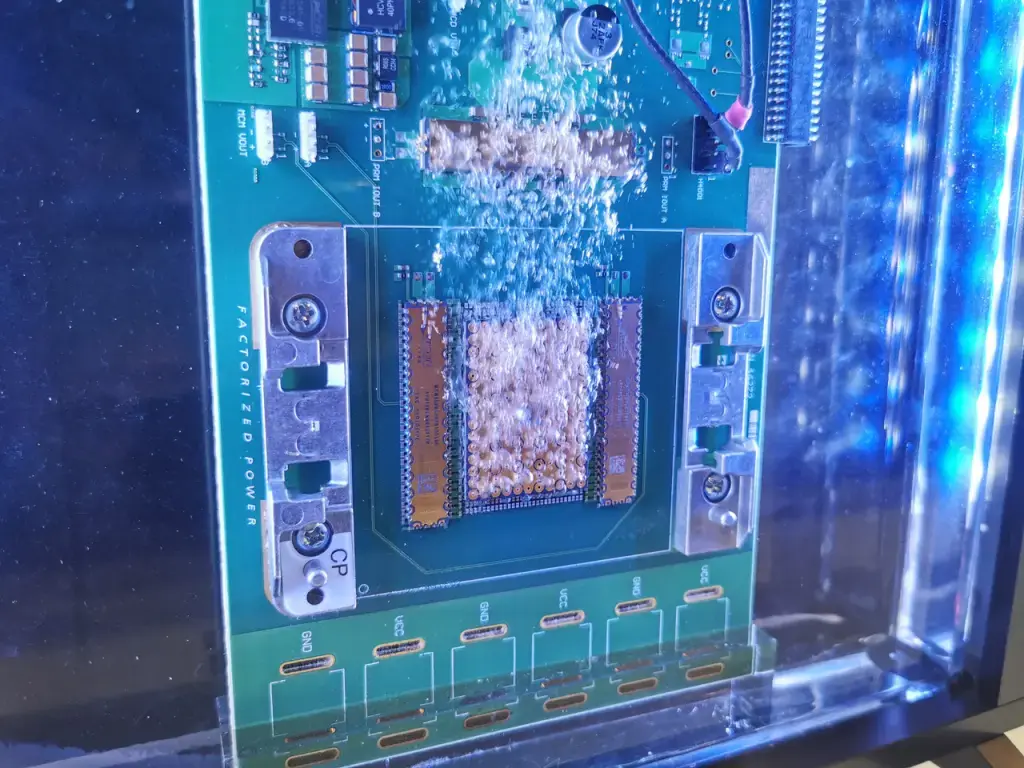

Ancora niente che bolle? Il raffreddamento a immersione sta arrivando

PUE ≈ 1,03–1,10

Il raffreddamento a immersione significa esattamente quello che sembra: il server viene completamente immerso in un liquido per lo scambio diretto di calore (anche se esistono concetti di immersione parziale). Perché far circolare il refrigerante in un intricato labirinto di tubi verso i singoli componenti, quando si può semplicemente immergere l’intero sistema in un fluido termicamente conduttivo?

Visivamente, assomiglia un po’ a una friggitrice industriale per server. Il serbatoio può persino contenere olio, solo che non quello con cui si cucina. Niente patatine, qui.

L’acqua normale non funziona (anche se l’acqua distillata tecnicamente non conduce elettricità). I sistemi a immersione utilizzano invece fluidi sintetici appositamente progettati, oli minerali o fluorocarburi. Questi liquidi sono non conduttivi (quindi sicuri per l’elettronica), hanno un’elevata capacità termica e sono estremamente efficienti nel sottrarre calore ai componenti.

Ed è qui che finalmente arriviamo al raffreddamento dei server con un liquido in ebollizione.

Ma questo…

lo vedremo la prossima settimana.