Hallo an unsere Stammleser – und an alle, die gerade erst vorbeigeschaut haben!

Was habt ihr bereits über die neuesten Trends in der Serverkühlung gehört? Vielleicht etwas zum Thema Flüssigkeitskühlung? Oder über Rechenzentren auf dem Meeresboden?

Alles faszinierend, keine Frage. Aber wenn euch die Überschrift über Server in kochendem Wasser neugierig gemacht hat;

wenn ihr noch nie davon gehört habt, Trinkwasser zur Kühlung zu verwenden, keine Ahnung habt, was kapillare CPU-Kühlung ist, und der Begriff PUE euch absolut nichts sagt – dann seid ihr hier genau richtig.

In diesem Artikel zeige ich euch, wie sich die Serverkühlungsbranche an Chips anpasst, deren TDP mit Vollgas auf die 1000-Watt-Marke zusteuert.

Warnung: Es wird ein langer Text.

Holt euch also eine Thermoskanne mit Tee, Kaffee oder etwas Stärkerem, damit euch nicht kalt wird 🙂

Alle wollen eine niedrigere PUE

PUE (Power Usage Effectiveness) ist die am weitesten verbreitete Kennzahl in der Rechenzentrumsbranche zur Messung der Energieeffizienz der Infrastruktur. Sie eignet sich hervorragend, um die Entwicklung eines einzelnen Rechenzentrums über die Zeit zu verfolgen und die Auswirkungen unterschiedlicher Entscheidungen zu bewerten, etwa beim Wechsel des Kühlsystems oder bei der Umkonfiguration der Hardware.

Am sinnvollsten ist PUE, wenn man sie auf eine konkrete Anlage anwendet. So sieht man, welche Lösungen die Energieeffizienz im realen Betrieb tatsächlich verbessern.

Die Kennzahl wurde 2007 von The Green Grid (TGG) eingeführt, einem gemeinnützigen Industriekonsortium mit dem Ziel, die Ressourceneffizienz in Rechenzentren zu steigern. Zu den Mitgliedern gehörten oder gehören praktisch alle großen Namen aus der Welt von Serverhardware, Komponenten, Software und Cloud-Services: AMD, Nvidia, Dell, HPE, IBM, Intel, Microsoft, Google, Cisco, Oracle, AWS und viele andere.

Die PUE-Formel ist simpel:

PUE = Gesamtleistungsaufnahme der Anlage / Leistungsaufnahme der IT-Hardware

Zur IT-Hardware zählt alles, was tatsächlich Rechenleistung bringt: Server, Storage-Systeme, Netzwerkgeräte sowie Hilfskomponenten wie KVM-Switches, Monitore und Arbeitsstationen oder Laptops zur Überwachung und Verwaltung des Rechenzentrums.

Die Gesamtleistungsaufnahme der Anlage umfasst alles, was der Standort verbraucht: IT-Hardware plus Stromversorgungskomponenten, USV-Systeme, Schaltanlagen, Generatoren, PDUs, Batterien und sämtliche Energieverluste außerhalb der IT selbst. Hinzu kommen Kühlsysteme wie Chiller, Kühltürme, Pumpen, CRAC-Einheiten (Computer Room Air Conditioning), DX-Systeme (Direct Expansion), und mein persönlicher Favorit unter den Akronymen: CRAH-Einheiten (Computer Room Air Handling). Außerdem gibt es sekundäre Verbraucher wie Beleuchtung, Zutrittskontrollen und weitere Gebäudetechnik.

Theoretisch liegt die perfekte PUE bei 1,0.

Das würde bedeuten: 100 % der Energie fließen in Rechenleistung, 0 % in Infrastruktur – Kühlung, Beleuchtung und alles andere. In der Praxis ist das jedoch unerreichbar. Aber: je niedriger die PUE, desto besser.

Es ist ein bisschen wie der Versuch, im Weltraum die Lichtgeschwindigkeit zu erreichen: Man kann sich annähern, aber kein Objekt mit Masse wird sie jemals erreichen.

Eine nahezu science-fiction-artige PUE von 1,03 bedeutet: Für je 100 W Rechenleistung benötigt das Rechenzentrum nur 3 W für alles andere.

Und das größte Hindernis auf dem Weg zu einer niedrigeren PUE?

Die Kühlung.

Die Kühlung allein macht bis zu 40–50 % des gesamten Energieverbrauchs einer Anlage aus. Und mit klassischen luftbasierten Kühlsystemen liegt man meist am oberen Ende – etwa bei 50 %. Flüssigkeitskühlung oder Free Cooling können diesen Anteil jedoch auf 20–30 % senken, unter günstigen Bedingungen sogar noch weiter.

Schauen wir uns also mal die konkreten Kühlansätze an, mit denen sich die PUE senken lässt.

Spoiler: Es gibt viele davon – und welche sinnvoll sind, hängt vom Alter und der Größe der Anlage, der eingesetzten Hardware, dem Standort, der Auslastung und zahlreichen weiteren Faktoren ab.

Kühlt eure Hardware

Beginnen wir mit den Grundlagen.

Alles, was mit Strom betrieben wird, erzeugt Wärme. Bei Haushaltsgeräten ist diese Wärmeabgabe meist gering und erfordert keine besonderen Maßnahmen – Ingenieure setzen hier in der Regel auf passive Kühlung, also die natürliche Wärmeabfuhr durch Luftströmung, technisch gesprochen: Konvektion.

In seltenen Fällen (PCs, Smartphones und Laptops ausgenommen) besitzen Haushaltsgeräte auch kleine Lüfter, wie zum Beispiel mein Massagegerät.

Die großen Ausnahmen zu Hause sind Klimaanlagen und Kühlschränke. Passive Kühlung oder ein paar Lüfter reichen hier nicht aus. Diese Geräte geben Wärme nicht nur ab, sie entziehen aktiv einem geschlossenen Raum Wärme, um eine konstant niedrige Temperatur zu halten.

Hier kommen Kältemittel ins Spiel: spezielle Substanzen, die in einem geschlossenen Kreislauf zirkulieren, im Inneren des Kühlschranks oder der Klimaanlage Wärme aufnehmen und sie nach außen abgeben. Deshalb brummen Kühlschränke manchmal (der Kompressor verdichtet das Kältemittel) und fühlen sich außen warm an (der Kondensator gibt Wärme ab). All das ist Teil des sogenannten thermodynamischen Kältekreislaufs.

Zurück zu unserem Lieblingsthema: Server.

Sie nutzen eine Kombination aus passiver Kühlung (Kühlkörper), Lüftern und kühlschrankähnlichen Systemen – Chiller oder Flüssigkühlungen mit Phasenwechsel. Die Kühlung kann entweder direkt auf den Server selbst abzielen (also die Komponenten im Inneren) oder auf die Umgebung, was typischerweise über Klimaanlagen geschieht.

Ich werde all diese Ansätze noch behandeln, inklusive einiger eher unkonventioneller. Wir arbeiten uns von einfach bis extrem vor (ja, kochendes Wasser kommt ganz zum Schluss).

Passive Kühlung und Luftkühlung: PUE 1,5–2,0

Geringe Anfangskosten, aber schwach und ineffizient

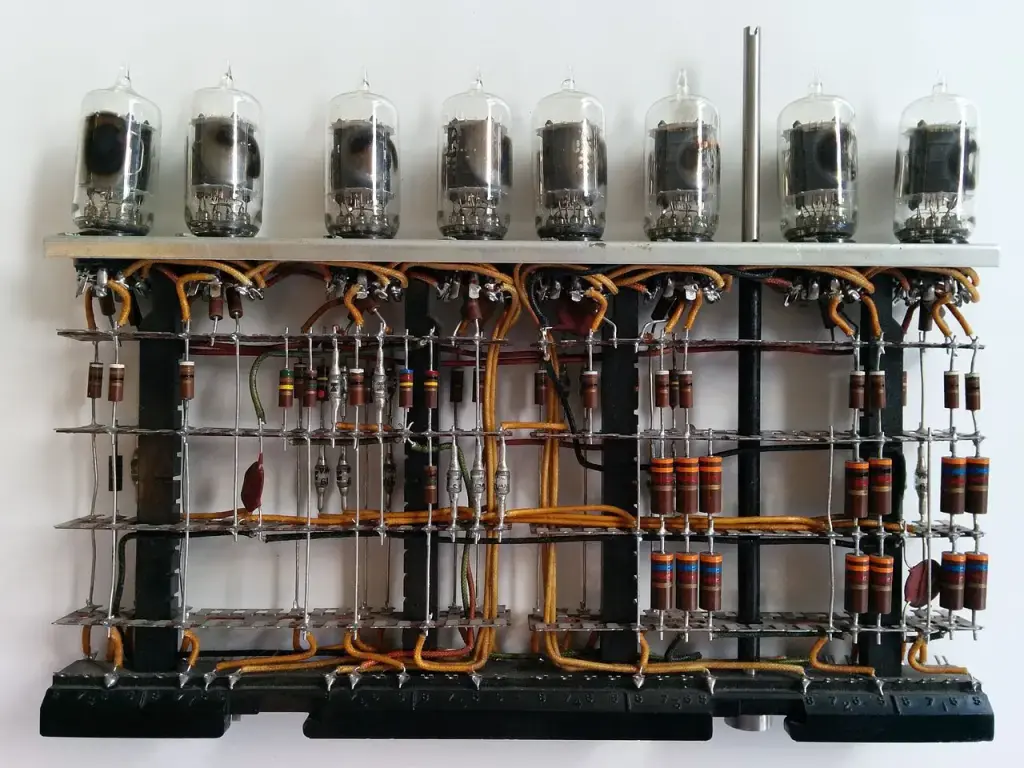

In der Ära der ersten elektronischen Computer – ENIAC, IBM 701 und ähnliche Maschinen der 1940er- und 1950er-Jahre – gab es keine aktive Kühlung. Natürliche Konvektion und einfache Raumlüftung reichten aus.

Ja, diese Maschinen erzeugten Wärme im zweistelligen Kilowattbereich. Aber die Bauteildichte war gering – alles basierte auf Elektronenröhren – sodass sich das Problem über Raumaufteilung und Architektur lösen ließ.

In den 1960er-Jahren hielten Transistoren Einzug und verkleinerten Computer drastisch. Damit begann die Ära der aktiv gekühlten Systeme. Mainframes wie der IBM System/360 setzten bereits auf Lüfter, die sich schnell als Standard etablierten.

In den 1980er-Jahren traten PCs ihren weltweiten Siegeszug an. Systeme wie der IBM PC verwendeten Lüfter in den Netzteilen.

Der Apple II hingegen setzte vollständig auf passive Kühlung. Steve Jobs lehnte Lüfter ab, weil sie seiner Meinung nach „Zen-Prinzipien verletzen und von der Arbeit ablenken“. Beim Apple III verfolgte er einen ähnlichen Ansatz – mit vorhersehbaren Überhitzungsproblemen.

Mit der Zeit wurden CPUs immer heißer. Gegen Ende des Jahrzehnts benötigten einige Modelle schließlich Kühlkörper. Intels legendärer 80486, insbesondere der höher getaktete 486 DX2-66, gehörte zu den ersten Prozessoren, die wirklich einen aktiven Kühler brauchten (Kühlkörper mit Lüfter).

Und von dort aus entwickelte sich die Kühltechnik stetig weiter …

Meiner Ansicht nach erreichte die Luftkühlung ihren Höhepunkt Anfang der 2000er-Jahre. Damals entstanden immer ausgefeiltere Designs: Heatpipes, Kupferkühlkörper, Hochdrehzahl-Lüfter und die heute standardmäßigen Hot-Aisle-/Cold-Aisle-Konzepte in Serverräumen und Rechenzentren (Server saugen vorne kalte Luft an und blasen hinten heiße Luft aus).

Luftkühlung wurde zunehmend mit Flüssigkeitslösungen kombiniert – AIO-Systeme (All-in-One) und Custom-Loops – insbesondere bei High-Performance-Systemen und Overclocking-Setups.

Fun Fact: In Servern besitzen CPUs meist keine individuellen Kühler. Stattdessen wird der Luftstrom gezielt durch Kanäle geführt und direkt durch die auf den Prozessoren montierten Kühlkörper gepresst.

Bis heute ist Luftkühlung der am weitesten verbreitete Ansatz, sowohl bei PCs als auch bei Servern. Ihre Beliebtheit verdankt sie dem niedrigen Preis, der vergleichsweisen Zuverlässigkeit und der Einfachheit. Perfekt ist sie allerdings nicht. Mit steigender Komponenten- oder Rack-Dichte sinkt die Effizienz. Der Lüfterlärm kann ohrenbetäubend sein (deshalb stehen Server in Serverräumen – neben einem zu arbeiten macht keinen Spaß). Staubablagerungen erfordern regelmäßige Reinigung oder Luftfilterung, was in Rechenzentren leistungsstarke HVAC-Systeme notwendig macht.

Immerhin lässt sich selbst dieser Nachteil nutzen: Abwärme kann zurückgewonnen und weiterverwendet werden, etwa zum Heizen von Büros oder sogar benachbarten Wohngebäuden.

Server-Luftkühlung ≠ PC-Luftkühlung

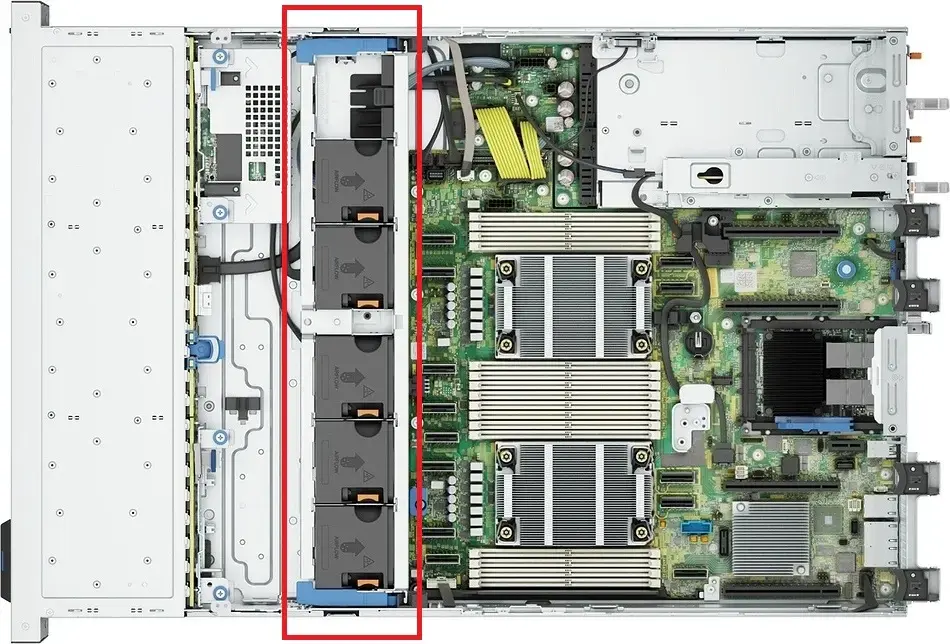

Luftkühlung in Servern sieht anders aus als im Desktop-PC. Die meisten Server sind flache 1U- oder 2U-Systeme (1U = 44,45 mm Höhe), was keinen Platz für Standard-120-mm-Lüfter lässt. Da Platz extrem knapp ist, wird Luft durch enge Kanäle gepresst – mit hoher Strömungsgeschwindigkeit und viel Turbulenz.

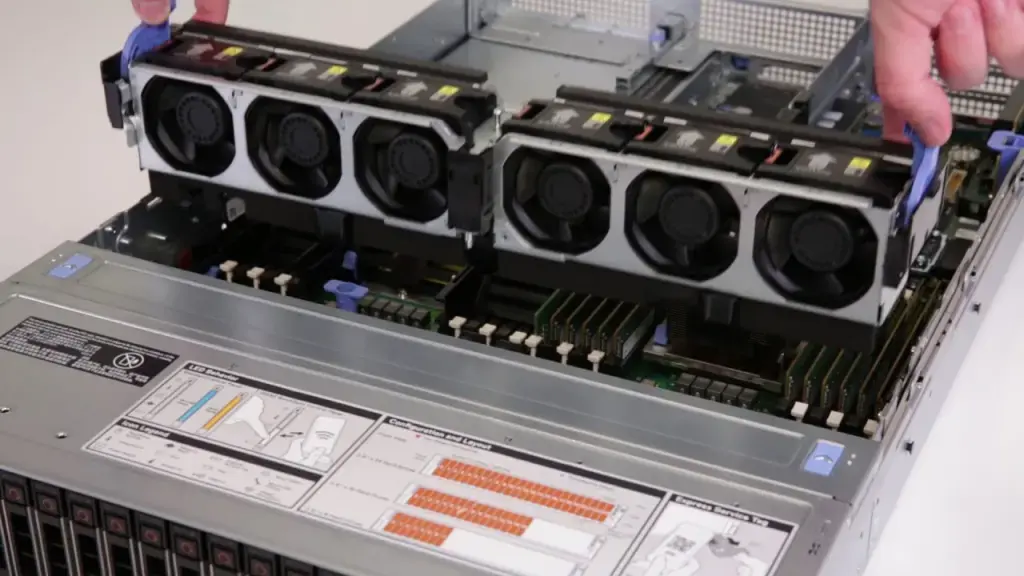

Erfahrene Sysadmins erinnern sich vielleicht an Kühlmodule wie dieses:

Ein großer 120-mm-Radiallüfter in der Mitte, flankiert von zwei kleineren Lüftern.

Heute setzen die meisten Server jedoch auf kompakte Hochdrehzahl-Lüfter, typischerweise 40×40 mm oder 60×60 mm. In größeren Systemen (4U und mehr) kommen gelegentlich auch größere Lüfter zum Einsatz. Übliche Drehzahlen liegen zwischen 10.000 und 20.000 U/min, manchmal sogar darüber.

Daher stammt der berüchtigte Serverlärm. Man könnte ihn als „jetähnlich“ bezeichnen: Je kleiner die Lüfterblätter, desto lauter und hochfrequenter das Geräusch – inklusive entsprechender Vibrationen.

Flüssigkeitskühlsysteme (Liquid Cooling Systems, LCS)

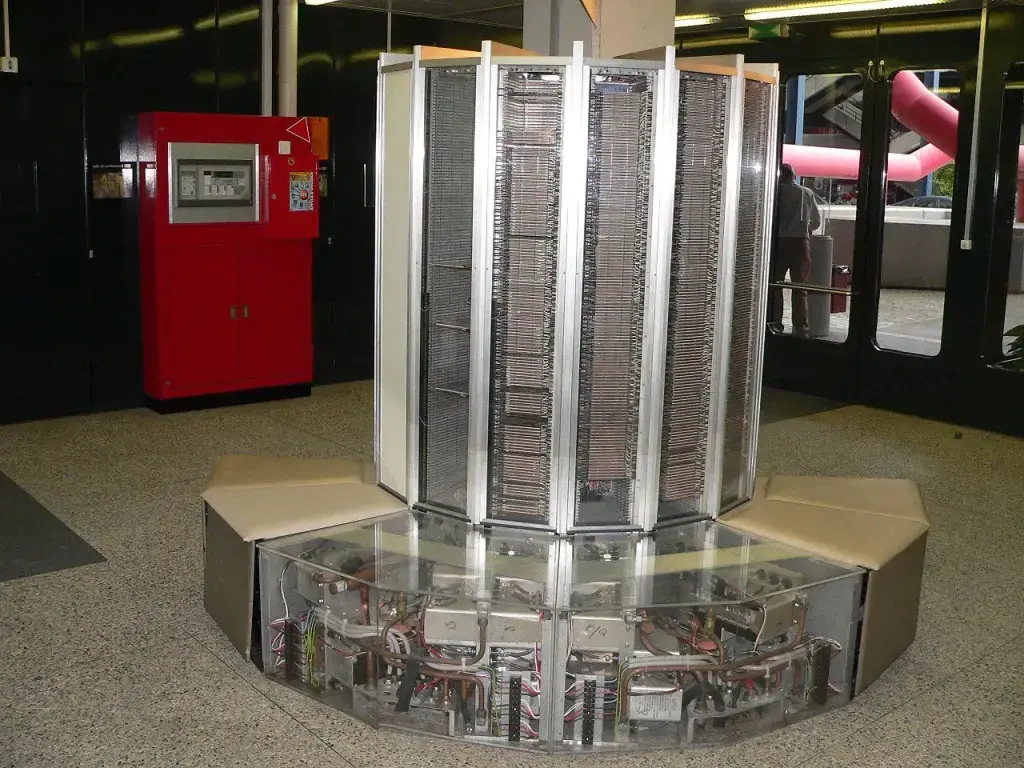

Die ersten Experimente mit Flüssigkeitskühlung für Elektronik reichen bis in die 1980er-Jahre zurück. Die Verlustleistung von Prozessoren stieg rapide, und Ingenieure suchten nach Alternativen. In den 1990er-Jahren wurde das Konzept schließlich kommerziell nutzbar. So setzten Cray-Supercomputer Flüssigkeitskühlung mit Freon-basierten Leitungen ein, um Wärme abzuführen.

Der Mechanismus ähnelte dem eines Haushaltskühlschranks und nutzte den Joule-Thomson-Effekt: Das Kältemittel kühlt sich ab, wenn der Druck beim Durchströmen enger Leitungen sinkt.

Streng genommen handelt es sich dabei um eine Zweiphasen-Flüssigkeitskühlung (oder schlicht einen Chiller), da das Kältemittel seinen Aggregatzustand ändert. Wie man sich denken kann, war diese Lösung jedoch groß, komplex und teuer und somit weit außerhalb der Reichweite normaler Anwender.

Die 2000er: Flüssigkeitskühlung wird Mainstream

Der eigentliche Boom kam in den 2000ern, als Overclocker, Gamer und Hardware-Enthusiasten begannen, eigene Kreisläufe mit Pumpen, Schläuchen, Waterblocks und Radiatoren zu bauen.

Damals konnte nicht jeder eine Flüssigkeitskühlung auf CPU oder GPU installieren. Genauer gesagt: nicht jeder konnte – und nur sehr wenige sollten es versuchen. Es war fast eine Kunstform und für manche ein Hobby oder sogar ein Beruf.

Der Prozess war komplex, teuer und nicht risikofrei. Ein Leck konnte ein System in Sekunden zerstören, einen Kurzschluss verursachen oder im schlimmsten Fall einen Brand auslösen.

Deshalb setzten sich in den 2010ern AIO-Flüssigkeitskühler durch. Vormontierte, geschlossene Kreisläufe wie der Corsair H100 oder der NZXT Kraken machten Flüssigkeitskühlung massentauglich. Plötzlich konnte jeder, der einen PC zusammenbauen konnte, auch eine Wasserkühlung installieren.

Und ja, es gab auch einige völlig wilde Experimente mit Kältemitteln im Consumer-Bereich.

Interessanter Fakt: Manche Systeme nutzen spezielle dielektrische Flüssigkeiten, die keinen Strom leiten und so das Schadensrisiko bei Lecks reduzieren.

Flüssigkeitskühlung für Server: New Game+, PUE 1,15–1,35

Direct Liquid Cooling (DLC) – auch Direct-to-Chip (D2C) genannt – bezeichnet die direkte Abfuhr von Wärme aus Serverkomponenten (CPUs, GPUs und mehr) durch direkten Kontakt mit einer Kühlflüssigkeit.

DLC-Systeme können einphasig oder zweiphasig sein, das Prinzip bleibt gleich: Die Flüssigkeit zieht Wärme direkt von den heißesten Komponenten ab. Der Kreislauf ist geschlossen; das Kühlmittel „badet“ CPUs und GPUs über Metall-Coldplates, die direkt auf den Hotspots montiert sind. Diese wirken wie thermische Schwämme und nehmen Energie auf.

Die erwärmte Flüssigkeit wird anschließend zu einer CDU (Coolant Distribution Unit) geleitet, dem Herzstück des Systems, wo die Wärme in den zentralen Kühlkreislauf der Anlage übertragen wird. Was danach passiert, hängt von der Ingenieurskunst ab: Wärmerückgewinnung (bis hin zur Einspeisung in Fernwärmenetze), Anschluss an Kaltwasserkreisläufe, Verdunstungskühltürme (optisch sehr kernkraftwerksartig) oder einfache Trockenkühler.

Nach der Abkühlung fließt die Flüssigkeit zurück zu den Chips – eine Art Wasserkreislauf im Serverraum.

DLC ist besonders gefragt bei hochdichten Servern mit leistungsstarken CPUs und KI-Beschleunigern, die enorme Wärmemengen erzeugen. Eine Nvidia H100 hat eine TDP von 700 W, die kommende Nvidia B200 liegt bei unglaublichen 1000 W. Moderne Intel-Xeon- und AMD-EPYC-Prozessoren geben routinemäßig 300–400 W ab.

Und nicht vergessen: In großen Rechenzentren gibt es Tausende – manchmal Zehntausende – solcher Chips, oft mehrere pro Server. In diesem Maßstab kann Luft die Wärme schlicht nicht schnell genug abführen, insbesondere in dichten Racks, in denen jeder Zentimeter zählt.

Kurzer Exkurs: TDP

TDP (Thermal Design Power) beschreibt die maximale Wärmemenge, die ein Prozessor, eine GPU oder ein anderer Chip bei Basistakt erzeugen soll – ohne Turbo-Boost oder Übertaktung. Sie dient vor allem der Dimensionierung der Kühlung: Je höher die TDP, desto leistungsfähiger muss der Kühler und/oder Radiator sein.

Wichtige Nuancen:

-

TDP ist nicht gleich realer Energieverbrauch. CPUs können ihre TDP kurzfristig deutlich überschreiten.

-

Hersteller berechnen TDP unterschiedlich TDP Intel und AMD nutzen verschiedene Methoden, direkte Vergleiche sind also mit Vorsicht zu genießen.

-

In kompakten Geräten wie Smartphones oder Laptops ist TDP besonders kritisch, da benachbarte Komponenten schnell zu Überhitzung und Drosselung führen. Große ATX-Gehäuse sind hier deutlich toleranter.

Warum DLC wichtig ist

Direct Liquid Cooling erlaubt es Rechenzentren, mehr Hardware auf gleicher Fläche unterzubringen und den Energieverbrauch um 30–50 % zu senken. Die Systeme sind leiser und somit ideal für Büros und On-Site-Serverräume, und weit weniger abhängig von der Umgebungstemperatur, was sie besonders attraktiv für heiße Klimazonen macht. Außerdem sammeln sie weniger Staub an, wodurch die Anforderungen an die Raumluft sinken.

Natürlich gibt es auch Nachteile. Installation und Inbetriebnahme sind teuer (auch wenn sich das durch Energieeinsparungen oft amortisiert, abhängig vom lokalen Strompreis). DLC erfordert zusätzliche Infrastruktur: Radiatoren, Pumpen, Wärmetauscher. Nicht jedes Gebäude eignet sich dafür. Und auch wenn moderne Systeme sehr sicher sind, bleibt ein Restrisiko für Lecks.

In der Gesamtbetrachtung ist DLC die Zukunft der Serverkühlung in Rechenzentren. Mit steigender Hardware-Dichte und der Dominanz von KI-Workloads wird die Nachfrage weiter wachsen. Die Technologie ist noch teuer, wird aber bereits weitläufig von Big Tech eingesetzt – Google, Microsoft, Amazon, Meta, Tencent – und hält zunehmend Einzug in kleine und mittlere Unternehmen, besonders in Regionen mit hohen Stromkosten, wo sich der ROI kaum ignorieren lässt.

Was gerade entwickelt wird: Kapillarkühlung direkt im CPU-Inneren

Was wäre nun aber, wenn die Kühlung im Prozessor selbst stattfinden würde?

Die Branche experimentiert mit Mikrokanälen, die direkt ins Silizium geätzt werden und Kühlmittel unmittelbar an den Chip heranführen. Weniger Schichten zwischen Wärmequelle und Kühlmittel bedeuten geringeren thermischen Widerstand – und deutlich schnelleren Wärmetransport.

Klingt perfekt. Aber wie immer gibt es einen Haken: Druckschwankungen im System können Hotspots und abrupte Temperatursprünge verursachen.

Forscher bei Microsoft ließen sich daher von der Biologie inspirieren. Sie entwickelten Mikrokanäle nach dem Vorbild des Blutkreislaufs – Arterien, Venen, Kapillaren. Heiße Chipbereiche erhalten hierbei mehr Kühlmittel, kühlere weniger. Die Ergebnisse sind beeindruckend: Spitzentemperaturen sanken um 18 °C, der Systemdruck um 67 %, und die Temperaturunterschiede zwischen den Kernen reduzierten sich um den Faktor drei.

und das Beste daran? Dieser Ansatz ist mit der CMOS-Technologie kompatibel – der Grundlage moderner Chipfertigung. Die Mikrokanäle lassen sich direkt während der Herstellung ins Silizium integrieren. In Zukunft könnte Kühlung somit kein externes System mehr sein, sondern Teil des Chips selbst.

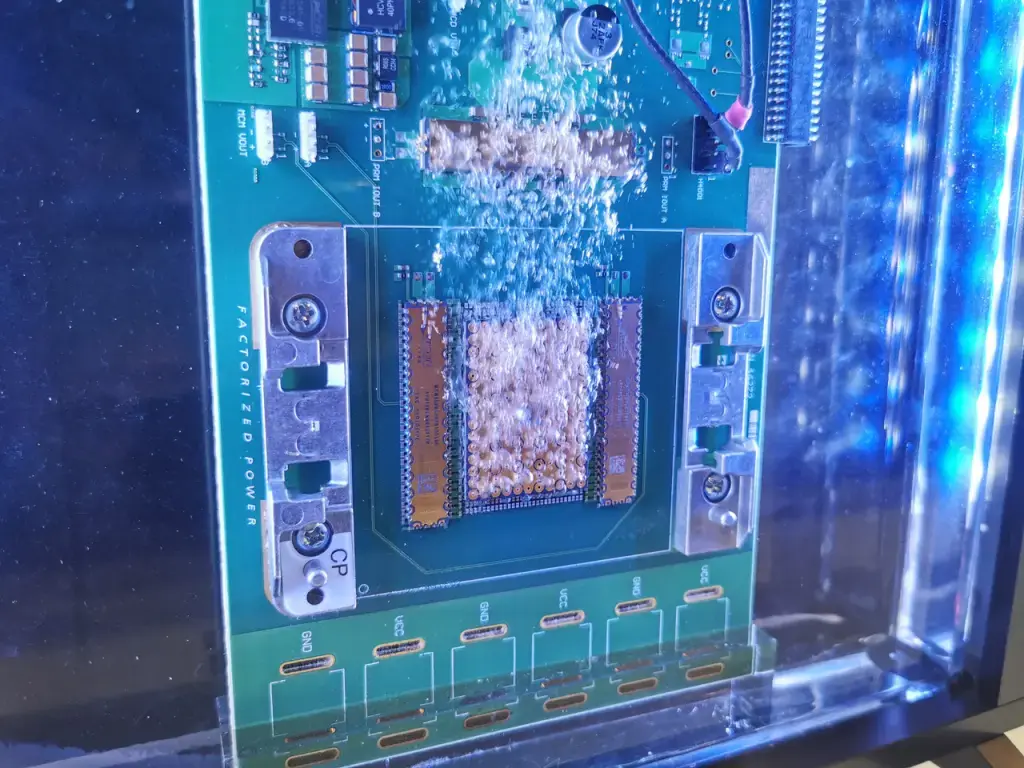

Noch nichts am Kochen? Immersionskühlung kommt auf euch zu

PUE ≈ 1,03–1,10

Immersionskühlung bedeutet genau das, wonach es klingt: Der Server wird vollständig in Flüssigkeit getaucht, um Wärme direkt abzuführen (es gibt auch Konzepte mit teilweiser Immersion). Warum Kühlmittel durch ein Labyrinth aus Schläuchen zu einzelnen Komponenten pumpen, wenn man einfach das ganze System in eine thermisch leitfähige Flüssigkeit setzen kann?

Optisch erinnert das Ganze ein wenig an eine Fritteuse für Server. Der Tank kann sogar Öl enthalten – allerdings nicht die Sorte, mit der man kochen würde. Pommes gibt es hier keine.

Reines Wasser funktioniert ebenfalls nicht (auch wenn destilliertes Wasser technisch gesehen nicht leitfähig ist). Stattdessen nutzen Immersionssysteme speziell entwickelte synthetische Flüssigkeiten, Mineralöle oder Fluorkohlenstoffe. Diese sind nicht leitend (also sicher für Elektronik), besitzen eine hohe Wärmekapazität und ziehen Wärme extrem effizient aus den Komponenten.

Und genau hier kommen wir endlich zur Kühlung von Servern mit kochender Flüssigkeit.

Aber das …besprechen wir nächste Woche.